1880 年代的美国,煤气灯还没从街头退场,两种截然不同的电力系统就已经在争夺未来。这段历史后来被拍成了电影,就是 2017 年那部由马丁·斯科塞斯担任执行制片、“卷福”等人主演的《电力之战》(The Current War),那场发生在十九世纪末的技术路线之争,至今仍是商业史上最经典的案例之一。

一边是爱迪生,1882 年他在纽约珍珠街建成了全世界第一个商用配电系统,用 110V 直流电点亮了曼哈顿下城区的几百盏白炽灯。爱迪生坚信直流电才是正道,投入重金铺设了整套配电网络。问题在于,直流电的电压很难改变。低压直流在导线中传输时电流大、损耗高,传个一两公里电压就跌得不成样子。爱迪生的方案本质上只能服务于发电站周围几个街区的客户。

另一边是乔治·威斯汀豪斯。他买下了尼古拉·特斯拉的交流电专利,包括那台改变历史走向的交流感应电机。交流电的关键优势在于变压器:一个简单的铜线圈加铁芯,就能把电压从几百伏升到几万伏。电压升高意味着同样功率下电流变小,导线上的损耗也随之骤降。发电厂可以先升压、远距离输送、到了用户端再降压使用。

这个优势是压倒性的。1893 年芝加哥世博会上,威斯汀豪斯用交流电点亮了整个展场,宣告了“电流战争”的终局。爱迪生输了。此后一百三十多年,交流电统治了从家庭插座到工厂产线的几乎所有用电场景,数据中心也不例外。

图丨1893 年芝加哥世博会(来源:Paleofuture)

但到了 2025 年,这个统治开始松动。

NVIDIA 在当年 5 月的 Computex 大会上公布了一套全新的 800V 高压直流(HVDC)供电架构,计划从 2027 年起替代数据中心内沿用多年的 54V 直流配电。几个月后的 OCP(开放计算项目)全球峰会上,配套技术白皮书正式发布。白皮书落地前后不到半年,英飞凌、德州仪器、意法半导体、台达、维谛(Vertiv)、施耐德、伊顿等供电链条上几乎所有关键角色同步宣布了各自的 800V 产品计划。产业链用不到一年的时间完成了集体转向。驱动力其实很简单:交流配电在 AI 数据中心里正撞上硬邦邦的物理极限。

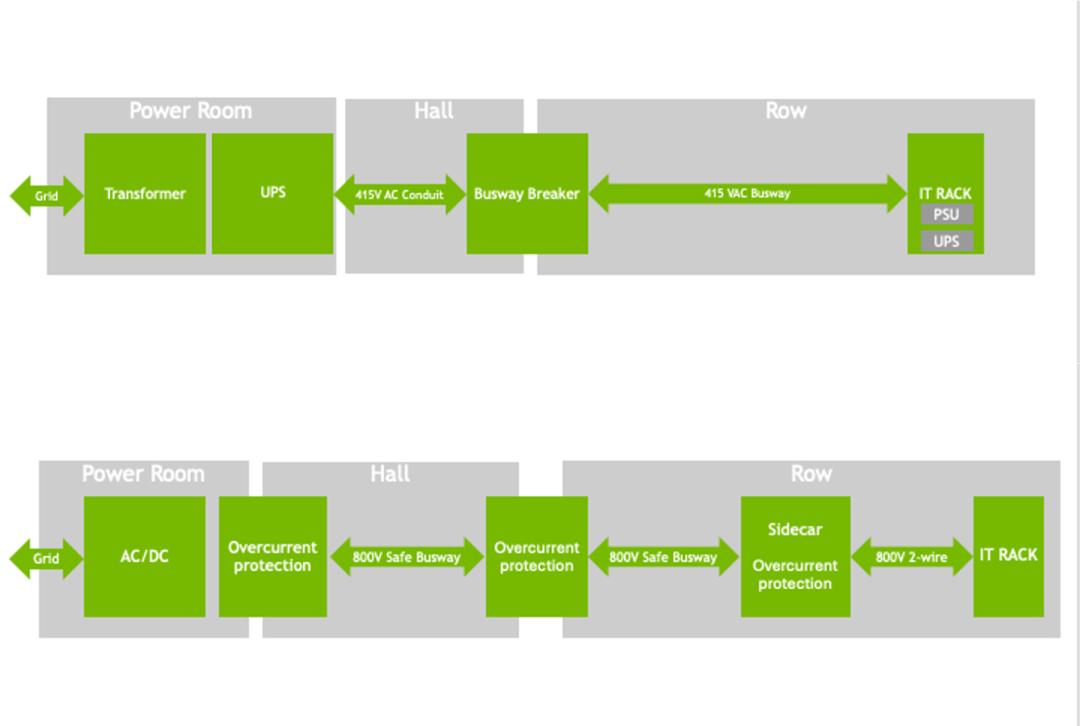

图丨当前数据中心供电架构(上)与 NVIDIA 800 VDC 架构对比(下)(来源:NVIDIA)

今天绝大多数数据中心的供电链路仍然遵循同一套模式:交流市电引入,经变压器降压,通过 UPS(不间断电源)做一轮整流再逆变,送进机架后由服务器自带的电源模块(PSU)再做一次 AC-DC 转换,才最终变成芯片能用的直流电。这条链路上至少经历三到四次电压转换,每转一次就要丢掉一些能量。行业公认的数字是,整条 AC 配电链的端到端效率在 85% 到 90% 之间。换句话说,从电网买来的电,有十分之一到七分之一还没碰到芯片就变成了热。

这个效率损失在传统数据中心时代尚可容忍,因为那时一个机架也就 10 到 15 千瓦,转换损耗产生的废热还在冷却系统的承受范围内。而这一波 AI 浪潮彻底打破了这个平衡。NVIDIA 现有的 GB200 NVL72 机架功率已逼近 120 千瓦,而 2027 年计划量产的 Rubin Ultra 平台瞄准的是单机架 500 千瓦到 1 兆瓦的量级。在这种功率密度下,交流配电的问题已经不再是“不够好”,而是在物理上已经行不通。

第一道墙是铜。功率等于电压乘以电流。54V 配电要扛住 1 兆瓦负载,电流接近两万安培。需要多粗的铜排来承载这个电流?NVIDIA 自己给出的答案是每机架 200 公斤。如果建一座 1 吉瓦级的数据中心,仅机架内的铜排就需要 20 万公斤。把电压提高到 800V 后,同等功率下电流降低约 15 倍,而导体所需的截面积与电流的平方成正比,这意味着铜材用量可以下降一个数量级以上。

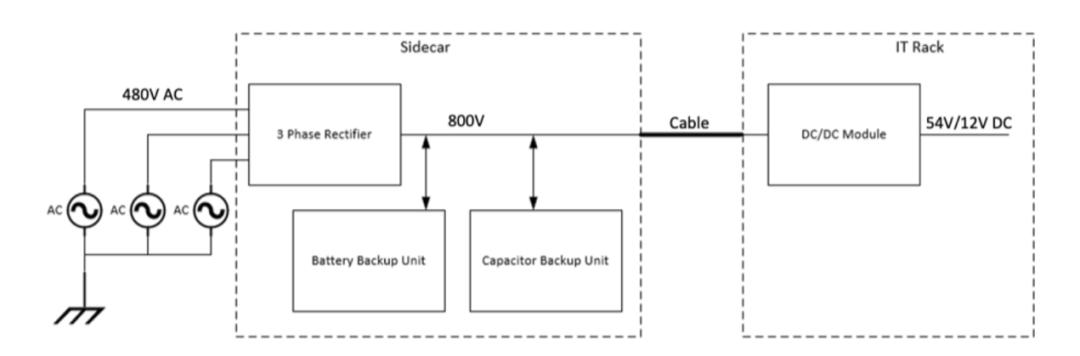

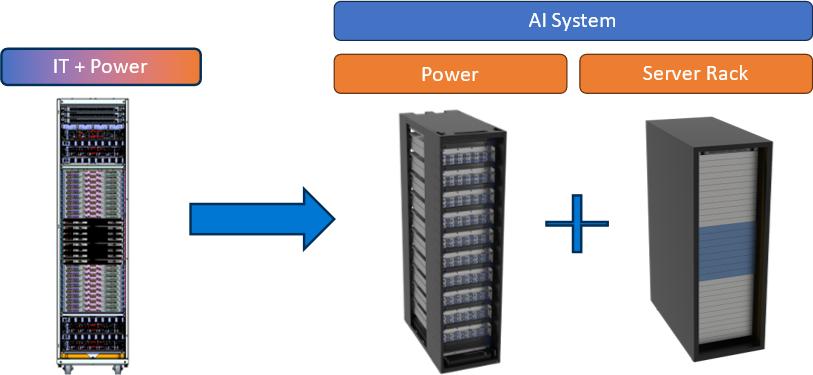

第二道墙是空间。以当前的 GB300 NVL72 系统为例,一个机架内要塞进最多 8 个电源架来供电。如果未来的兆瓦级机架还沿用 54V 架构,NVIDIA 估算电源设备将占满 64 个 U 位,整个机架全是电源,没有任何空间留给计算设备。这已经不是效率问题了,而是根本装不下。NVIDIA 在 GTC 2025 上展示的替代方案是一个 800V 独立的电源边柜“sidecar”,可以为同一机架内 576 块 Rubin Ultra GPU 供电,把电源彻底搬出计算空间。

第三道墙是散热。在 AC 供电链路中,每台服务器内部都要独立完成交流到直流的转换,转换效率通常在 90% 到 95% 之间,剩下的部分全变成热量散在机架里。二十台服务器挤在一个机架中,光电源转换就能产生一两千瓦的废热。

高压直流架构的思路则完全不同:把 AC-DC 转换集中到机架外部甚至建筑外部的大型整流设备中完成,然后直接用 800V 直流配送到机架。集中转换的效率更高(规模效应),而且废热产生在机房之外,不再加重机房内冷却系统的负担。即便只提升 1 个百分点的效率,对一座 100 兆瓦的数据中心来说也意味着 1 兆瓦的节省,这足以驱动好几个服务器机架。

NVIDIA 给出的综合预期是:端到端能效提升最多 5%,维护成本降低最多 70%,总拥有成本下降最多 30%。

但光有 NVIDIA 的架构设计还不够。800V 直流要真正跑起来,需要一整套从电网到芯片的供电产业链做出响应。2025 年下半年到 2026 年初,这条产业链在以前所未有的冲刺速度在重组。

在功率半导体层面,英飞凌宣布与 NVIDIA 合作开发 800V 供电平台的全链路方案,利用其碳化硅(SiC)和氮化镓(GaN)器件实现高频高效的电压转换,单级转换效率可达 98%。

德州仪器在 2026 年 3 月的 GTC 大会上展示了完整的 800V DC 电源架构,核心是一个两级转换设计:从 800V 直接降到 6V 中间母线,再从 6V 转换为 GPU 所需的亚 1V 核心电压,其中 800V 到 6V 这一级的转换效率达到 97.6%。

图丨德州仪器 800V DC 电源架构(来源:Texas Instrument)

意法半导体则拿出了 12 千瓦和 20 千瓦两款功率交付板,其 12 千瓦板在 800V 到 50V 的转换中实现了 97.5% 的峰值效率和 2500 W/in³的功率密度。纳微半导体(Navitas)更进一步,用 GaN 技术实现了 800V 到 6V 的单级直接转换,省去了传统的 48V 中间母线。

在系统集成层面,台达发布了 660 千瓦的 800V DC 列间电源机架并内置 480 千瓦的电池备份单元。维谛宣布其 800V DC 生态系统产品线将在 2026 年下半年商用,对接 NVIDIA 的 Rubin Ultra 平台。

施耐德公布了自己的 800V sidecar 方案,支持 NVIDIA、Google 和 Meta 等多家客户,并承诺在 NVIDIA 每一代新平台之前提前推出配套电源和散热方案。伊顿也在同期发布了专为 AI 数据中心设计的 800V DC 参考架构。

在更底层的机架标准上,变化同样在发生。DCD 近日的一篇报道引述了 Legrand 公司高级产品管理总监 Calvin Nicholson 的说法,描绘了 Open Compute 标准下电源架(power shelf)的演进轨迹:最早的 OCP 电源架是 18 千瓦,现在已经升级到 33 千瓦,下一代正在开发的是 72 千瓦。

Legrand 这两年在 Open Compute 生态中投入很深,开发了多种母排和电源架方案,还收购了一家冷却公司,加上此前收购的后门热交换器公司,正在把机架、母排、电源和散热整合成一套完整的系统交付给客户。

Nicholson 在采访中谈到了行业转型的阻力:运营关键基础设施的人天然厌恶风险,交流电用了一百多年,大家知道怎么部署、怎么维护、怎么保证安全。一旦切换到直流,一切都是新的,不同的机柜、不同的母排、不同的安全规程。

客户通常的做法是先把机柜、母排和电源架拿回去在实验室里反复测试,确认满足应用需求之后才会部署到生产环境。这是一个保守但合理的流程,因为涉及安全培训和运维规范的全面更新。更让客户头疼的是,他们的很多供应商正忙着追超大规模客户(hyperscaler),没有人坐下来帮他们理解这些新技术。

在这场全球性的供电架构转换中,中国的位置比较独特。一方面,中国在远距离高压直流输电领域的积累全球领先。国家电网和南方电网已建成超过 40 条特高压输电通道,其中包括世界首条±800 千伏特高压柔性直流工程和±1,100 千伏特高压直流线路,后者可以在 0.01 秒内将新疆的电力送到 3,300 公里外的安徽。中国是全球唯一全面掌握全系列特高压技术并大规模商用的国家。这种在电力电子领域长期积累的工程能力和人才储备,为数据中心 HVDC 的发展提供了基础条件。

另一方面,在数据中心直流供电的实践上,中国实际上早于海外走了一步。2007 年,江苏电信就开始试点 240V 高压直流供电。此后,以 BAT 为代表的互联网巨头在自建数据中心中广泛采用“一路市电 + 一路 HVDC”的双路架构。2019 年,阿里巴巴联合台达和中恒电气推出了“巴拿马电源”方案,从中压 10 千伏交流一步直转 240V 直流,省去了传统架构中的多级中间设备,系统效率达到 97.5%,占地面积缩减近 50%。

截至 2024 年,台达销售的巴拿马电源在线运行数量已超过 500 套。百度、腾讯和三大运营商也都在各自的数据中心中部署了 HVDC 方案。目前国内 HVDC 市场中,中恒电气占据 30% 到 40% 的份额,是阿里巴巴巴拿马电源的核心供应商。

不过,国内当前主流的 HVDC 电压等级仍是 240V,与 NVIDIA 推动的 800V 方案之间存在代际差距。2025 年 8 月,台达联合中讯邮电咨询设计院发布了中国首部《数据中心 800V 直流供电技术白皮书》,开始推动国内向更高电压等级演进。2026 年初,字节跳动在最新一轮 AI 数据中心招标中首次引入 800V HVDC 方案,计划将高压直流在新建园区中的渗透率提升至 30% 到 40%,并同步启动楼宇级、数十兆瓦规模的 800V 试点。

另据报道,除了阿里、腾讯外,国内其他云厂商也已开始小批量部署 HVDC。中恒电气、科士达、麦格米特、禾望电气等企业也在加速 800V 产品的研发,其中部分企业已作为维谛、施耐德等海外巨头的核心分包商进入全球供应链。

回到全球视角,800V HVDC 的落地时间表正在逐渐清晰,但路线并非只有一条。微软、Google 和 Meta 在 2025 年的 OCP EMEA 峰会上联合推出了“Mount Diablo”项目,采用±400V 方案而非 NVIDIA 力推的 800V,更强调短期可行性和对现有电动车行业成熟供应链的利用。

图丨Mount Diablo 将电源与计算分离(来源:Microsoft)

Meta 的±400V 方案预计 2026 年一季度率先落地。NVIDIA 的 800V 方案则锚定 2027 年,配合 Rubin Ultra 平台的量产时间节点。两条路线不算互斥,±400V 更像是一个过渡方案,而 800V 是面向兆瓦级机架的终局架构。更远的未来,固态变压器(SST)将中压电网输入一步转换为 800V 直流,连独立的整流环节都可以省去,进一步逼近供电效率的物理极限。

这一切在一年前还只是白皮书上的愿景。2026 年 3 月的 GTC 大会上,参展商展台上已经摆满了可以触摸的 800V 电源模块、母排和 sidecar 原型机。台达的 800V HVDC 电源机架设计功率达 570 千瓦,施耐德的 800V sidecar 已经进入工程验证阶段。NVIDIA 在技术博客中写道:我们不只是在造更快的 GPU,而是在重新设计整个供电堆栈。

爱迪生大概没有料到,为他的直流电翻盘的,不是什么新物理学,而是一块又一块越来越渴电的 AI 芯片。

参考资料:

1.https://spectrum.ieee.org/living-heart-project-virtual-twins

2.https://www.datacenterdynamics.com/en/marketwatch/the-future-of-rack-power-for-high-density-environments/

3.https://thefusionreport.substack.com/p/why-data-centers-are-switching-to

运营/排版:何晨龙