AIPress.com.cn报道

随着新任CEO的公布,苹果在AI的动向可谓是期待值拉满。

虽说没有赶上第一波AI大潮,但是从全网的爆料来看,iOS27已经做好摩拳擦掌惊艳众人的准备了。

从目前已确认的信息与权威爆料来看,iOS27并非一次追求花哨功能的表层迭代,而是苹果在AI时代的一次战略级变身。

最稳定的版本:iOS27

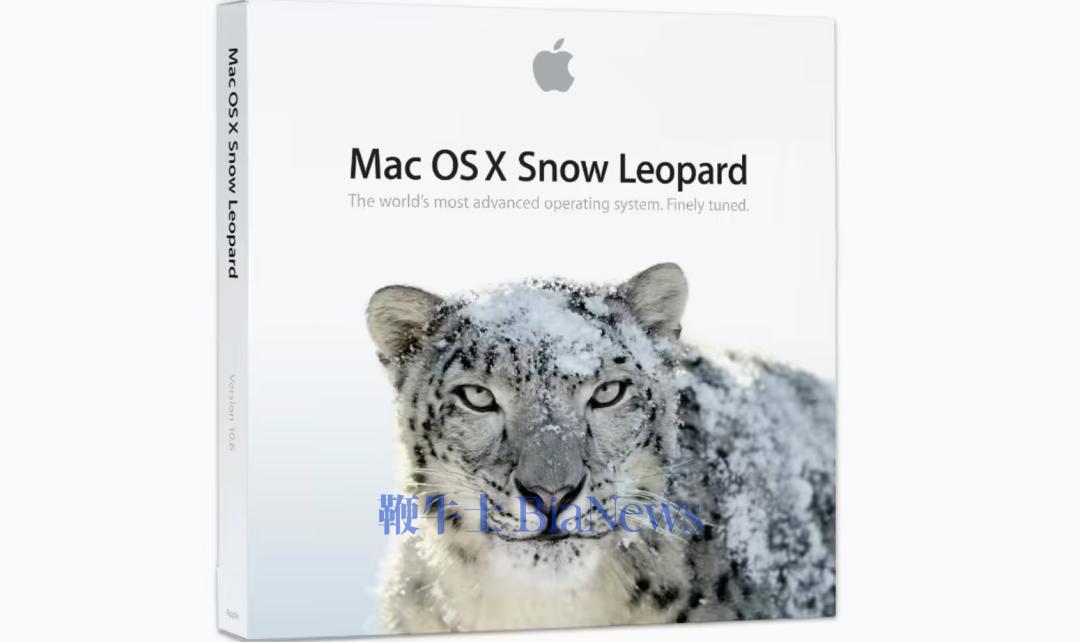

据彭博爆料,iOS27的内部研发代号为「Rave」,其核心更新思路参考了2009年发布的MacOSXSnowLeopard系统。

在当年,SnowLeopard放弃了大量炫技式的新功能,将核心研发重心放在系统性能优化、bug修复与底层稳定性提升上,最终成为MacOSX史上口碑最好的版本之一。

而iOS27的定位,正是移动生态的“SnowLeopard式更新”。

据知情人士透露,苹果已大幅降低了非核心功能的研发优先级,将核心资源向两大方向倾斜:

一是全链路的系统性能优化与质量管控,针对iPhone、iPad、MacBook全设备端的软件漏洞、运行卡顿等痛点进行集中修复,目标打造近年来最流畅、最稳定的iOS版本;

二是全场景AI能力的深度落地,为AppleIntelligence功能打造专属的系统底层优化,让AI能力的调用更顺滑、更省电、更贴合日常使用场景。

Siri:从语音助手到全功能AI入口

如果说iOS27是苹果AI战略的转折点,那么Siri的全面重塑,就是这场转折中最核心的标志性升级。

据爆料,这是Siri自诞生以来最大规模的一次形态与能力迭代,底层将接入谷歌Gemini大模型(项目代号Campo),完成从“语音助手”到“AI聊天机器人”的彻底蜕变。

最核心的变化,是苹果正在开发一款独立的Siri原生应用。

据爆料,这款App采用极简设计,界面风格酷似iMessage,以对话流的形式呈现交互,彻底打破了此前Siri只能单次唤醒、单次对话的限制。

用户不仅可以在App内进行连续追问、多轮对话,还能查看、置顶、搜索历史聊天记录,整体体验类似ChatGPT、Gemini等主流聊天机器人。

同时,App支持语音与文字输入模式的无缝切换,用户既可以用语音唤醒指令,也可以直接打字与Siri交互,彻底摆脱了此前“只能语音交互”的使用限制。

在能力层面,重构后的Siri传闻将实现三大维度的突破:

一是复合多任务处理能力,终于可以在单条用户指令中理解并连续执行多个任务,例如一句“查询明天的天气,顺便给妈妈设置晚上7点的电话提醒”,就能一次性完成全链路操作,无需再拆分成多条指令分步下达;

二是跨应用的深度联动能力,通过深度调用AppIntents框架,Siri可以直接读取用户的邮件、日历、屏幕内容,实现“识别屏幕上的地址一键存入通讯录”“根据邮件内容自动添加日程提醒”等操作,还能直接代用户在第三方应用内完成访问新闻、网页搜索等任务;

三是多模态处理能力,支持用户上传PDF、照片等文件,完成摘要提取、内容分析、信息查询等操作,无需再跳转第三方AI工具。

在系统交互层面,Siri也将迎来全新的设计升级。

爆料称,新版Siri将深度融入灵动岛,唤醒后灵动岛会自动扩展,显示“搜索或提问”的提示与发光光标,不再占用半屏界面,交互更轻量化、更丝滑。

更值得关注的是,苹果将为Siri开放第三方扩展能力,在AppStore设置专属的扩展板块,用户安装对应扩展后,即可将Claude、Gemini等主流AI聊天机器人接入Siri,打破了此前仅支持ChatGPT集成的限制。

视觉智能全场景落地

在iOS27中,随iPhone16推出的VisualIntelligence(视觉智能)功能将迎来全面革新。

4月16日,MacRumors发布博文称,通过挖掘iOS27Beta版代码字符串发现,苹果将在新系统中大幅拓展视觉智能的应用场景,不仅将其原生整合进相机应用,更实现了与健康、通讯录等系统应用的深度联动,同时为未来的可穿戴设备预留了能力接口。

据代码推断的信息,最核心的变化是相机应用内将新增专属的Siri/AI模式,该模式与照片、视频、人像等经典拍摄选项并列展示,快门按钮同步显示AI图标,用户一键即可唤醒全部AI视觉能力。

同时,苹果也将同步重新设计相机App界面,包括优化后的快门按钮、直观的手势控制,简化导航流程,降低AI功能的使用门槛。

除此之外,据爆料升级后的视觉智能还将实现全场景的能力覆盖:

镜头对准植物、地标、产品,即可在几秒内给出详细信息,还能直接调用ChatGPT进行提问,甚至一键发起谷歌反向图片搜索;

对准外语文本,即可完成实时翻译,无需再手动输入翻译软件;

对准合同、文件,即可一键扫描并通过AI提取文本关键点,转换成可编辑格式,实现办公场景的效率升级。

在苹果的布局中,视觉智能的升级绝非单纯的相机功能优化,而是其整个AI生态的感知入口。

消息显示,iOS27中的视觉智能能力,将实现与未来智能眼镜、带摄像头的AirPods等可穿戴设备的联动,让这些设备具备实时环境感知、信息解析的能力,为苹果的空间计算生态打下了坚实的感知基础。

在过去的AI浪潮中,苹果始终保持着审慎的节奏,仅在iOS26中推出了基础的AppleIntelligence功能。

而iOS27的相关爆料,清晰地展现了苹果的AI布局思路:不做孤立的大模型产品,而是把AI深度融入整个生态。(转载自:AI普瑞斯)