安杰尼・米达

安杰尼・米达(AnjneyMidha)曾是安德森・霍洛维茨(a16z)普通合伙人,也是Anthropic的早期个人投资人。据我的同事凯蒂报道,他终于准备公开披露其备受期待的AI基础设施创业项目,此前他曾试图为此募集超100亿美元资金。

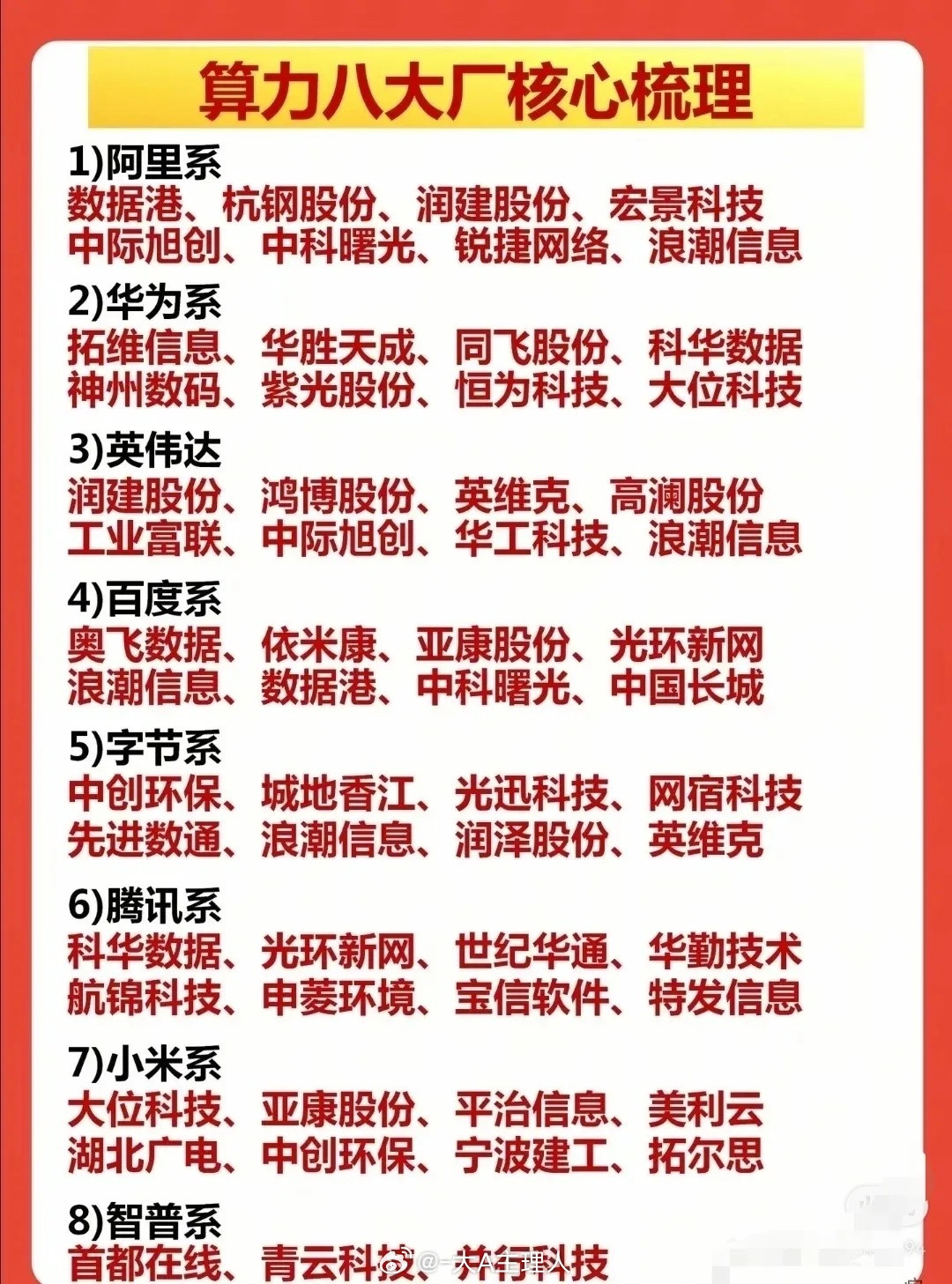

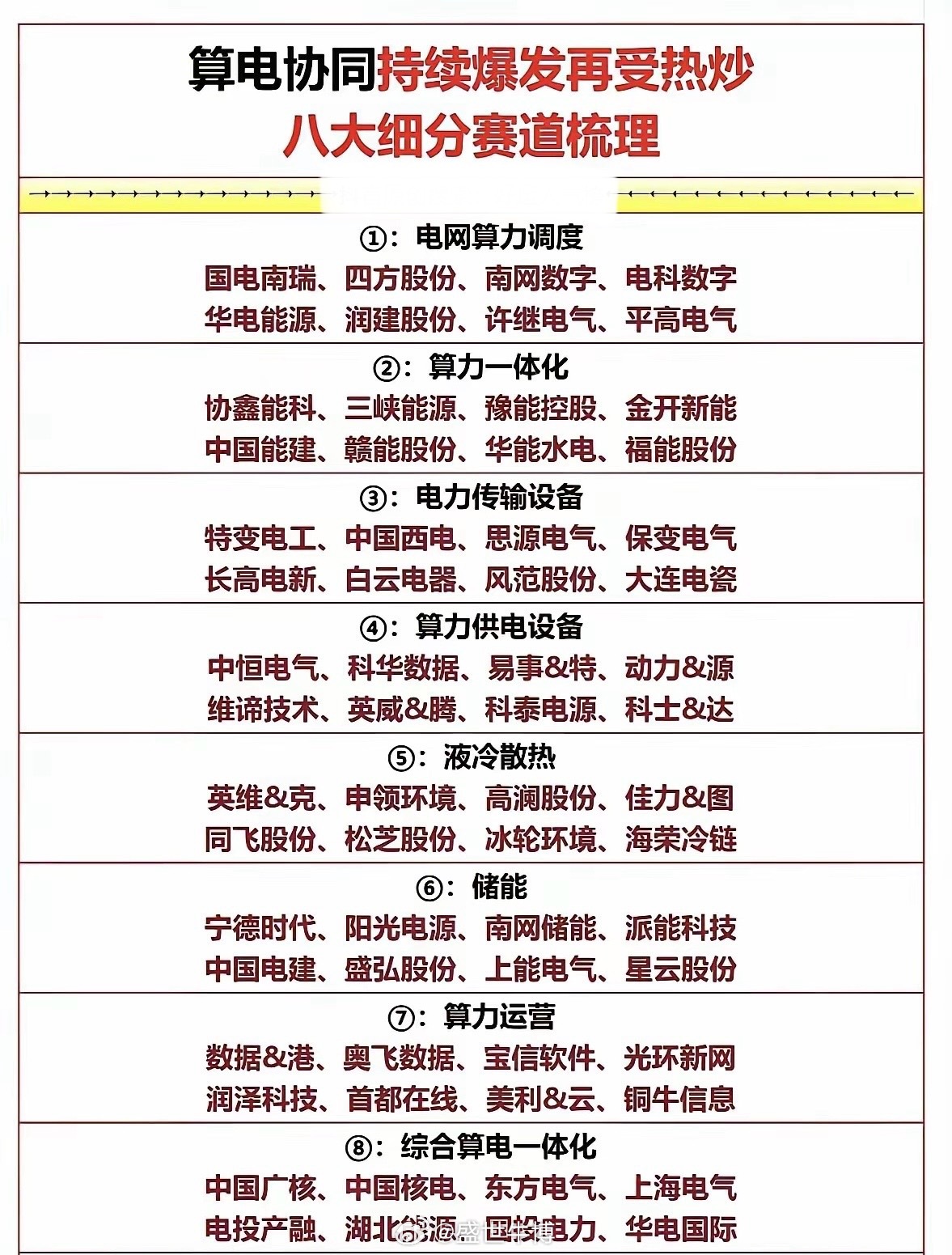

米达表示,这家名为AMP的新公司正在打造一张“AI算力电网”,其模式类似于由中央电网统一调度供电的体系,将彻底改变AI开发者获取稀缺服务器资源的方式。(AMP这一名称恰取自电流计量单位“安培”。)

在英伟达GTC大会上与米达深入交流后,我意识到他正在推进一个酝酿数年的理念:AI算力资源应像公共电力一样售卖,从而实现更低成本、更广覆盖。

OpenAI首席执行官山姆・奥特曼上周在贝莱德基础设施峰会上也谈及这一构想,不过他表示OpenAI自身会成为这类资源的供给方。

无论如何,这都将与当前AI基础设施的销售模式形成巨大转变!

在安德森・霍洛维茨任职期间,米达就已搭建了AMP的雏形项目——Oxygen算力集群,该项目汇集英伟达芯片供旗下投资组合公司共享使用。由于担忧AI算力资源正快速向少数手握大量GPU的企业集中,他决定将该项目独立出来,成立AMP公司。

目前,英伟达图形处理器(GPU)基本通过长期租赁(预留实例)或按小时租用(竞价实例)两种方式供应,米达认为这种分配方式从根本上缺乏效率。

正如一个世纪前电网成为企业共享稀缺电力的关键设施,AMP希望为有服务器需求的AI开发者提供同样的共享模式。米达的设想是,AI开发者无需各自采购、运维基础设施——无论是向云厂商或芯片企业租赁还是购买——转而使用一套更高效的共享系统。

他不愿透露AMP的其他合作方,无论是服务器供应商还是算力使用方,但表示顶尖研究实验室与云厂商已参与该项目。

他并未披露AMP的商业模式。与自建并运营数据中心不同,AMP将推出一款应用,连接服务器供给方与有需求的AI开发者。米达将其比作电力系统中的独立系统运营商——这类机构未必拥有底层基础设施,却负责统筹供需调度。

为此,AMP正在开发一套软件,用于在AI开发者间分配共享算力池,并调度不同计算任务的运行时间与节点。但AMP不会按小时出租GPU,也不直接向AI开发者收取费用。

不止于GPU

值得关注的是,AMP计划支持开发者租用各类AI硬件。米达未透露谷歌张量处理单元(TPU)是否会纳入其中,但考虑到AMP创始团队包含曾负责谷歌大型基础设施内部管理系统的工程师,其具备搭建相关体系的能力合情合理。(据此前报道,谷歌已采取实际举措,向谷歌云以外的AI开发者开放TPU使用。)

目前市场上也有整合多方AI服务器的企业,如TogetherAI与英伟达自身(后者曾尝试搭建闲置GPU交易市场),但AMP的模式难以简单对标。

米达表示:“你必须成为中立、独立的主体,制定统一标准,允许所有参与方接入。”

AMP计划于今日晚些时候发布一份使命宣言,旨在吸引更多企业加入这张算力电网。我十分好奇最终会有哪些机构参与其中。

当前,AI企业普遍将服务器资源视为战略优势,因此需要提供相应的经济激励,才能促使它们使用AMP系统或贡献自有服务器。

考虑到米达作为早期投资人与Anthropic的密切关联,我倾向于认为Claude的开发方Anthropic会参与该项目。

米达拒绝就公司资本结构置评,但表示过去数月已为该项目投入数亿美元启动资金。

算力规模化难题

米达创立AMP的灵感,源于他与Anthropic及其他初创企业的合作经历,他亲眼见证服务器对新模型研发的重要性。通过提升算力规模训练新模型,是AI领域众所周知的“缩放定律”。

但他表示,服务器规模化落地并非易事,因为开发者对算力设备的需求难以预测。

“观察算力负载就会发现,需求波动非常剧烈,”他说,“一个团队的负载模式通常是:大规模训练任务引发峰值,随后是周期性的研究与推理工作,极难预测。”

这导致AI开发者要么向云厂商预留的服务器不足,要么超额预留最终大量闲置。开发者还始终面临两难选择:是用稀缺算力训练更优模型,还是用其运行现有模型为客户服务以创造收入。

他说:“全球前沿研究领域中许多最高产的团队,在使用算力这一最宝贵资源时,效率却也是最低的。”

在很多情况下,这会促使企业囤积AI服务器芯片——即便大量设备处于闲置状态。“这一点让我深感困扰。”他说道。