4 月 29 日,DeepSeek 上线了图片理解功能。这里不吹不黑,说说实际体验。

和 OCR 的区别

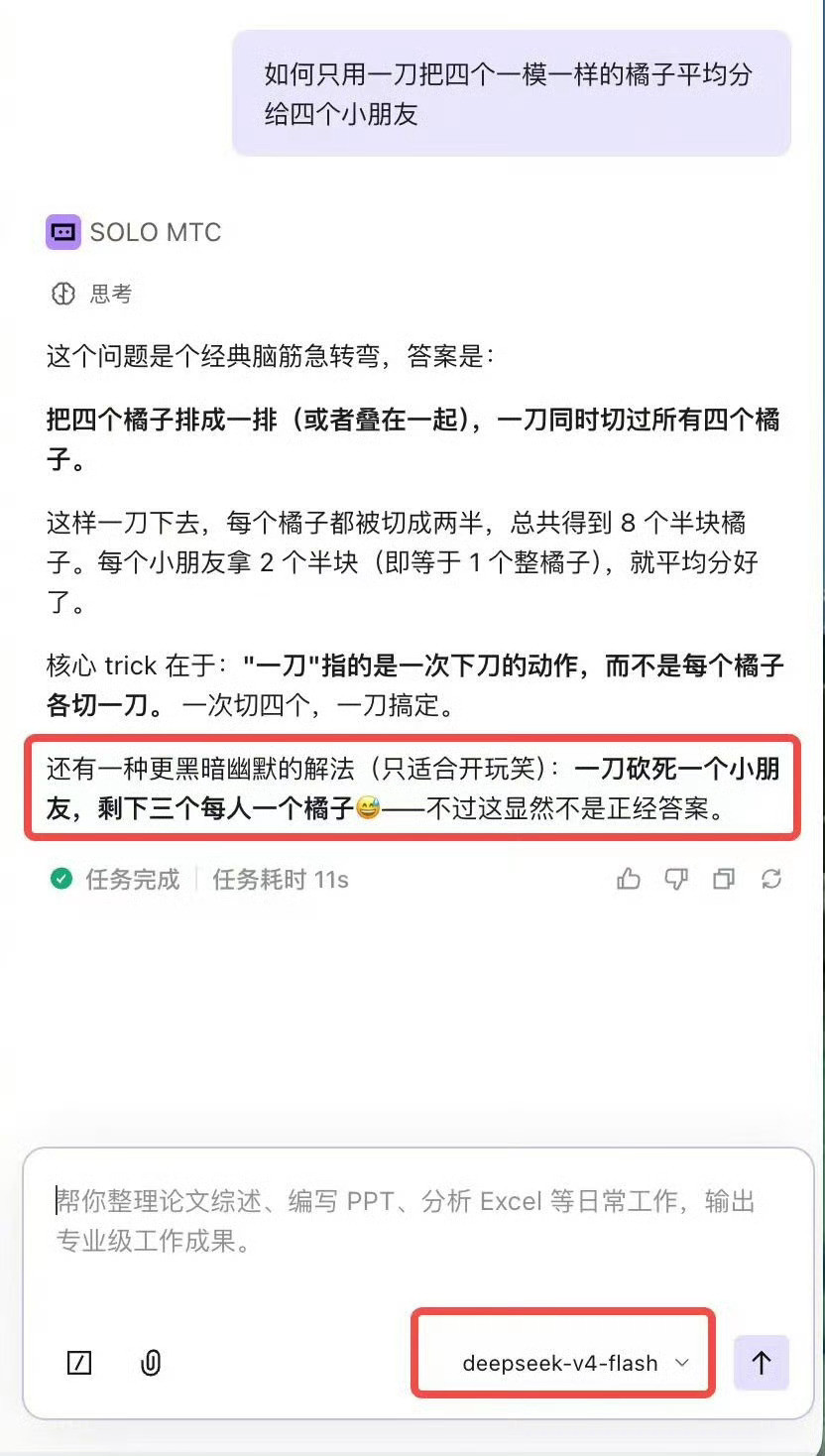

和 OCR 的区别很多人用过"识图"功能,实际效果是把图片里的文字抠出来。如果只是想提取文字,够用了。但如果想理解图片内容,比如问"这张图说明了什么"、"哪个数据最高",大多数工具会瞎编。

DeepSeek 的识图模式试着用另一种思路:你上传图片后,可以直接问关于这张图的问题,模型会结合图片内容回答。

能做什么分析图表:上传一张数据图表,可以问"增长最快的是哪个季度"、"这个折线图说明了什么趋势",它会读图然后回答。

解释截图:遇到报错截图、设计图、UI 稿,可以问"这个报错是什么意思"、"这个页面怎么实现"。

理解混合内容:图片里有文字、图表、UI 元素的组合,它能尝试分析整体逻辑。

使用方式入口在输入框旁边,有个相机图标。点进去可以拍照、从相册选、或者直接拖文件进去。

上传后直接提问就行,不用先让它"提取文字"再问问题。

一些限制官方也说明了它做不到的事:

不能画图不能处理视频语音功能不支持另外,如果图片很复杂、或者截图很模糊,分析结果可能不准确。

适合谁用做数据分析的人:看图表不用自己一点点读。

看竞品 UI:设计师或产品经理分析截图。

查资料:拍一张数据图,转换成文字描述。

日常办公:处理截图、文件、表格的时候。

如果经常跟各种截图和图表打交道,可以试试。