技术巡猎 极氪 晕车识别方法、电子装置和车辆。车能不能提前发现后排乘客快要晕车了?成年人晕车是可以喊出来的,小孩就麻烦很多,尤其是坐在儿童座椅里的低龄儿童,很多时候表达不清楚,前面开车的大人也不可能一直回头看。极氪的思路,是把车内摄像头、车辆运动状态、环境信息,甚至声音信息放到一起判断。它关注的不是单一动作,而是一个完整场景。

先看人。车内OMS摄像头可以识别乘员的视觉特征,比如皱眉、眼睑下垂、脸色变化、捂嘴、头部后仰、趴伏、姿态异常。这些东西单独看确实很普通,小孩困了也会眯眼,太阳刺眼也会皱眉,玩累了也会趴着。但晕车早期恰恰就藏在这些细小变化里,专利把视觉特征放在主分支,判断晕不晕车,首先还是看这个人的状态。

再看车。专利里提到的车辆环境特征,包括纵向加速度、横向加速度、垂向加速度、颠簸频率、车内温度、湿度等等,其实就是有没有急刹、急加速、急转弯、连续晃动、路面颠簸,车里是不是又热又闷。

这个判断是关键的。同样是孩子皱眉,如果车刚经历一段连续弯道,横向加速度反复变化,车内温度又偏高,那这个皱眉就不能简单当成“表情管理失败”,它可能是晕车开始的信号。

但如果车辆一直很平稳,孩子只是被阳光照了一下,模型就应该把这个因素给过滤掉。

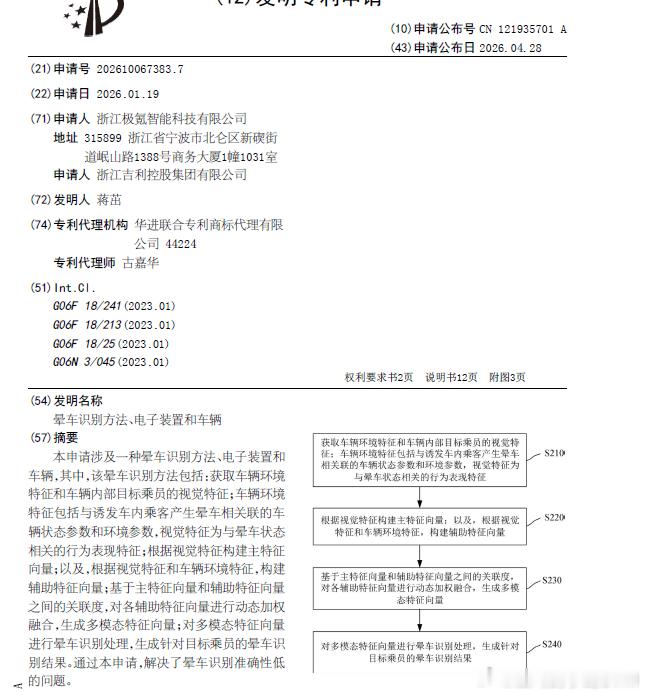

这里面的技术重点,是多模态融合。简单说,视觉特征负责回答“这个人现在怎么样”,车辆环境特征负责回答“刚才这段路对身体刺激大不大”,声音特征可以补充“有没有哭闹、呜咽、呻吟”。最后模型通过注意力机制,把这些信息动态加权。

动态加权用人话说,就是系统会判断哪些信息更有用。比如孩子捂嘴,同时车辆刚经历频繁刹车和转弯,这两个信号关联度高,权重就上来了;如果孩子只是普通活动,车辆也很平稳,那相关性就会比较低,系统不该过度解读。

这个逻辑比“看到孩子哭就报警”会更成熟。因为车内儿童场景太复杂了,哭可能是困,可能是饿,可能是不想坐安全座椅,也可能是真的晕车。只靠一个摄像头,很容易误识别,叠加车辆运动和环境,模型就有了上下文。

专利里用了连续时间序列的多模态特征,也提到可当前帧和历史帧之间做注意力计算。这其实是在让车回忆刚才发生了什么。

还提到了可变形注意力层。这个听起来比较学术,其实就是模型不必平均看所有历史画面,而是去找关键时刻。比如孩子状态第一次明显变化的那一秒,或者车辆运动刺激最强的那一段。

这套东西真正落地,最大的难点我觉得是训练数据。儿童晕车早期状态很难标注,轻微不适、中度不适、即将呕吐,这些标签不是能脑补出来的。还要考虑光线、坐姿、遮挡、安全座椅、儿童年龄差异,甚至有些孩子天生表情少,有些孩子本来就闹腾。

所以这项技术核心在数据闭环和整车联动。

识别只是第一步。车发现后排孩子可能晕车之后,能不能提醒驾驶员柔和驾驶?能不能建议开窗、调低温度、切外循环?能不能让底盘和动力响应进入更舒适的模式?导航能不能避开连续山路或者拥堵走走停停路段?这些才是后续真正能提升体验的部分。