[LG]《Hyperloop Transformers》A Zeitoun, L Torroba-Hennigen, Y Kim [MIT] (2026)

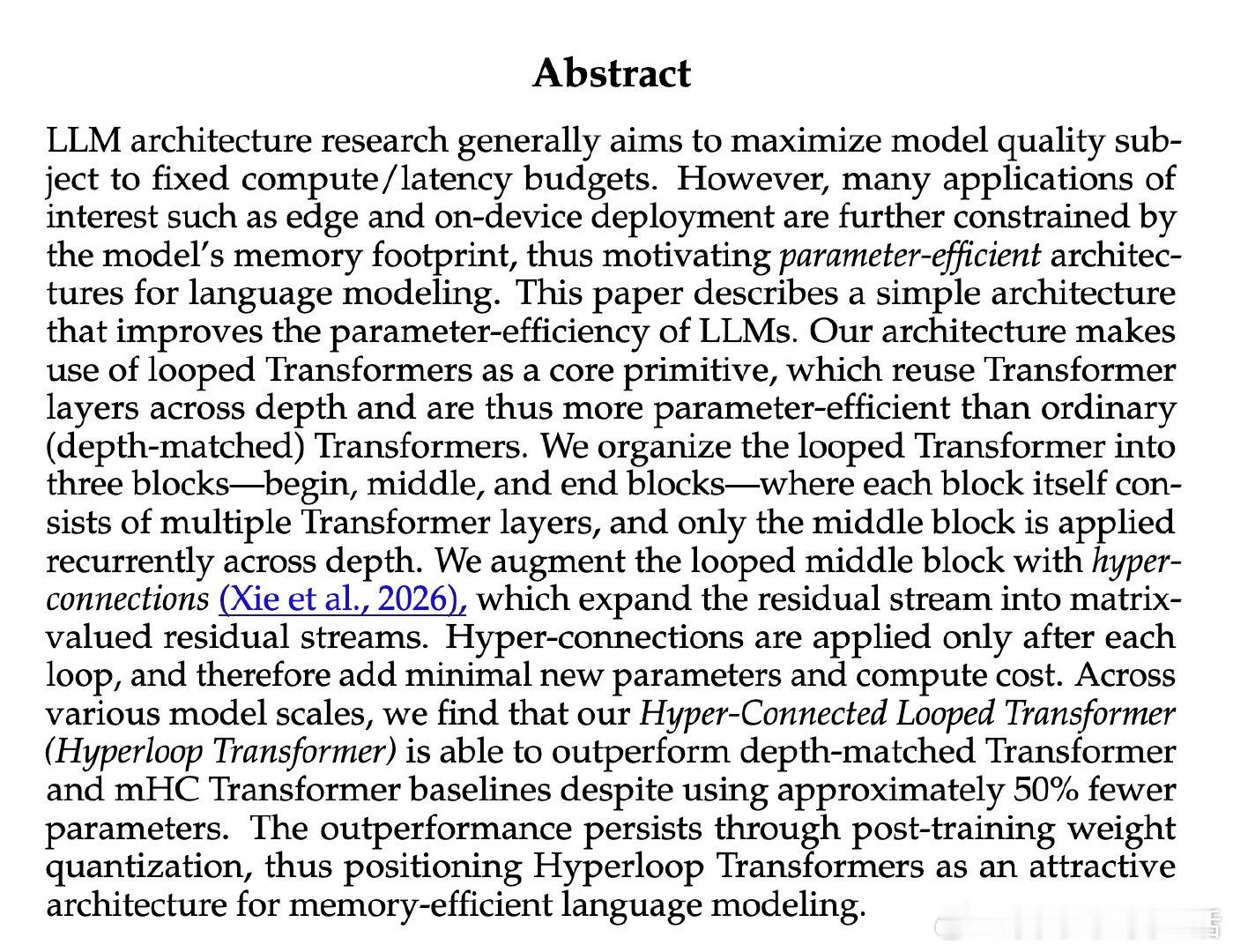

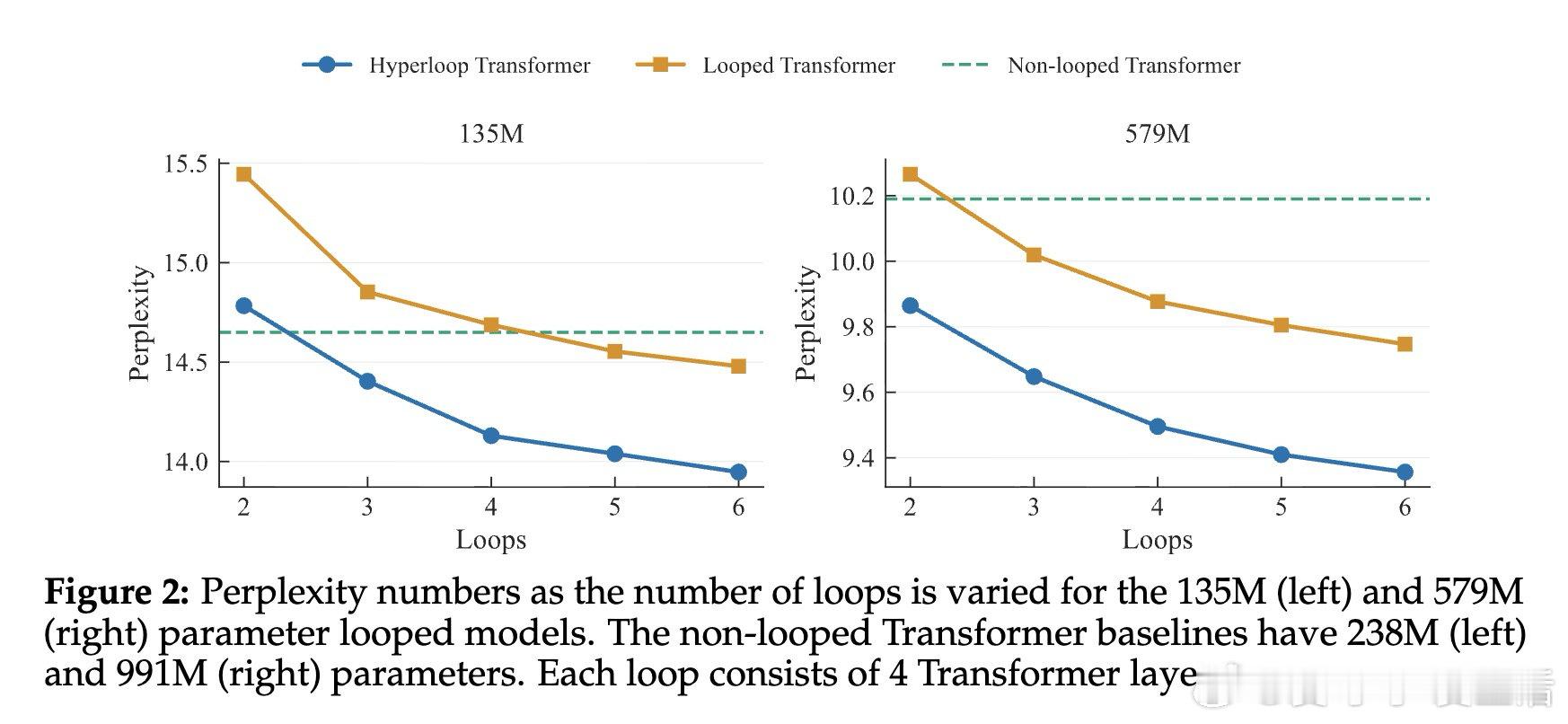

在大语言模型部署中,边缘设备和端侧场景受限于内存容量(如手机仅8-16GB RAM),使得模型参数量成为能否运行的硬约束。传统Transformer虽性能优异,但参数冗余严重;循环Transformer虽参数高效,但在困惑度上仍落后于同深度的非循环模型。

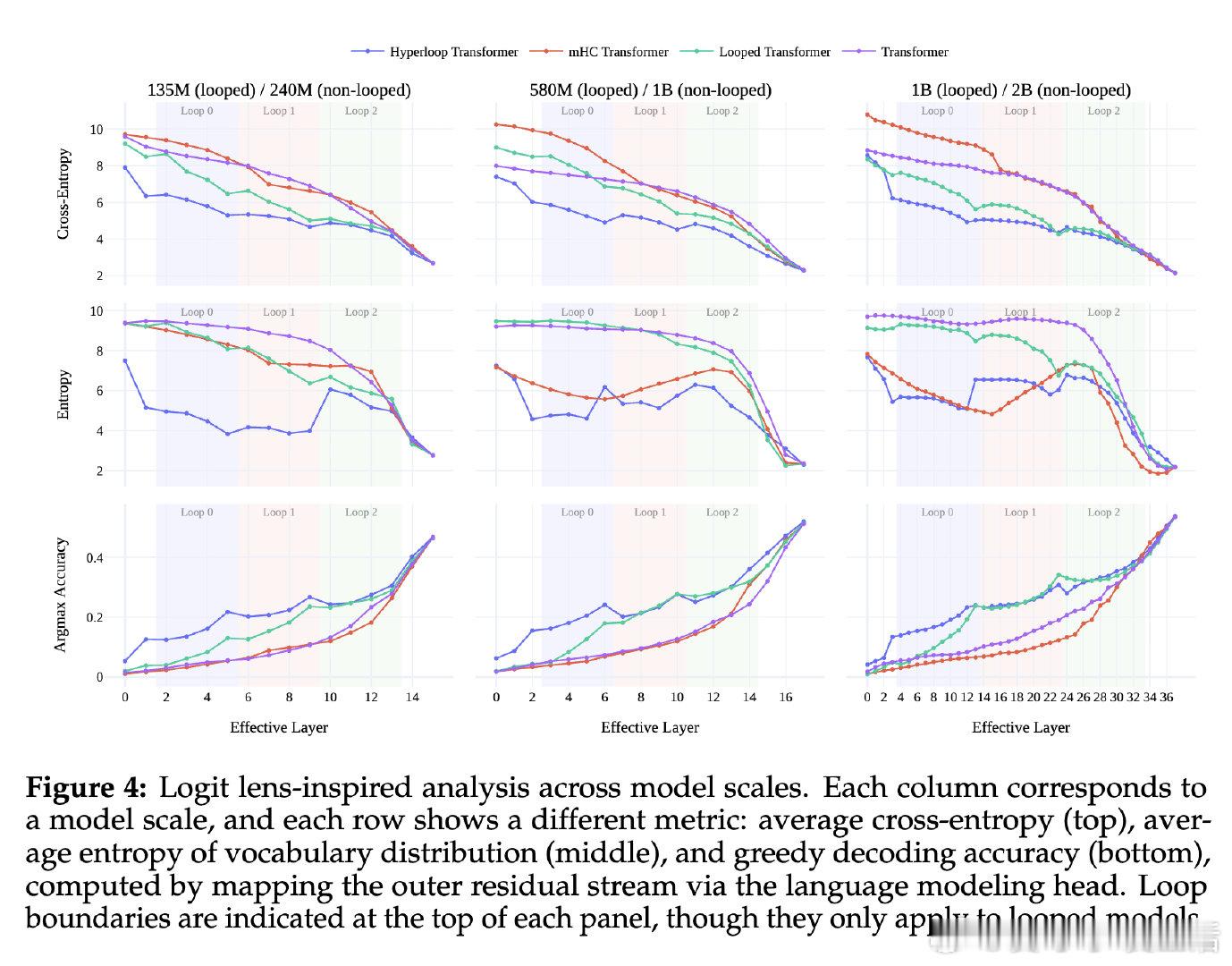

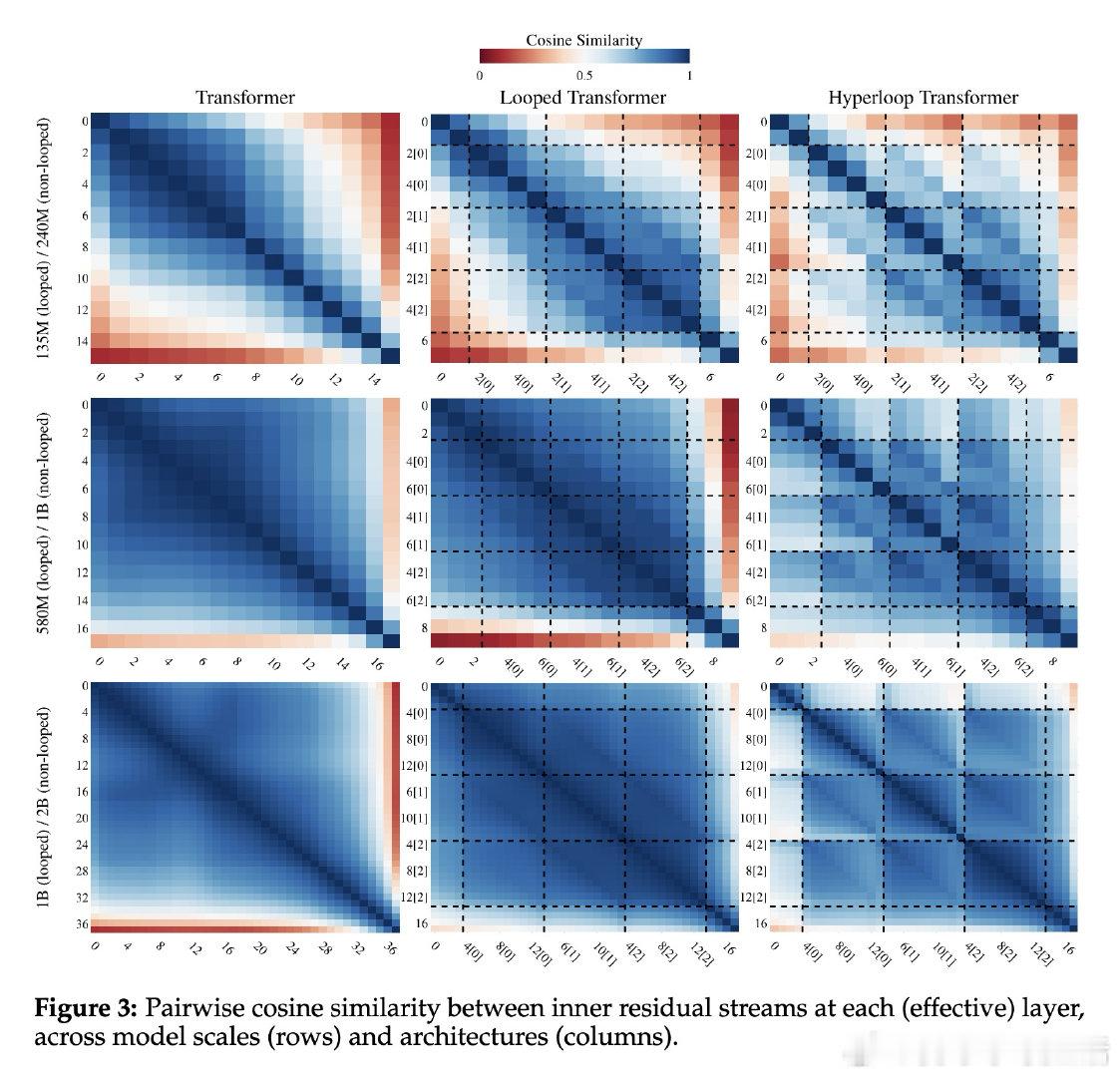

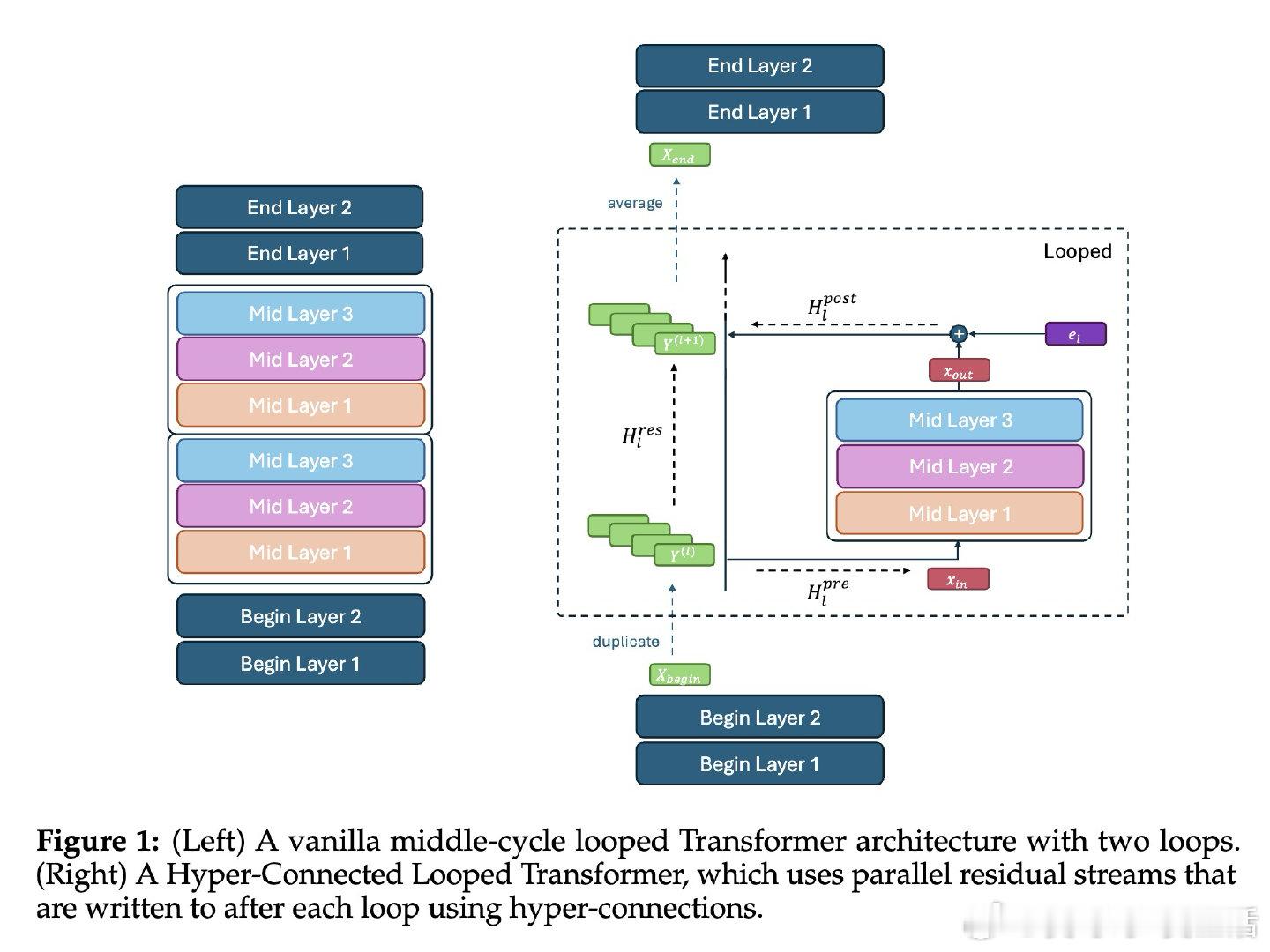

本文的核心洞见是:将循环Transformer的残差流从向量扩展为矩阵,并仅在循环边界处施加超连接(hyper-connection)。具体而言,将模型分为起始、中间、结束三个块,仅循环中间块,并在每次循环后通过输入依赖的投影矩阵读写多条并行残差流。这种"循环级超连接"使参数在循环间可微调变化,同时几乎不增加计算开销。

这项工作真正留下的遗产是:用50%参数量达到甚至超越全参数Transformer的性能,且该优势在INT4量化后依然保持。它为后来者打开的新门是将参数效率作为独立优化轴,使超大模型在有限加速器上可部署;但尚未跨过的门槛是更大规模(如万亿参数)下的验证,以及循环深度作为测试时计算缩放轴的潜力尚未充分挖掘。

arxiv.org/abs/2604.21254 机器学习 人工智能 论文 AI创造营