[LG]《Generalization at the Edge of Stability》M Tuci, C Korkmaz, U Şimşekli, T Birdal [Imperial College London] (2026)

在深度学习中,大学习率训练常使最大Hessian特征值超过稳定阈值2/η,进入"稳定边缘"(EoS)——此时优化轨迹呈现振荡甚至混沌,传统凸优化理论预测发散,但实践中模型反而泛化更好。现有基于单点"平坦度"的理论(如Hessian迹)既无法解释EoS下的稳定性,也无法预测泛化:存在平坦却泛化差的极小值,也存在尖锐却泛化好的解。

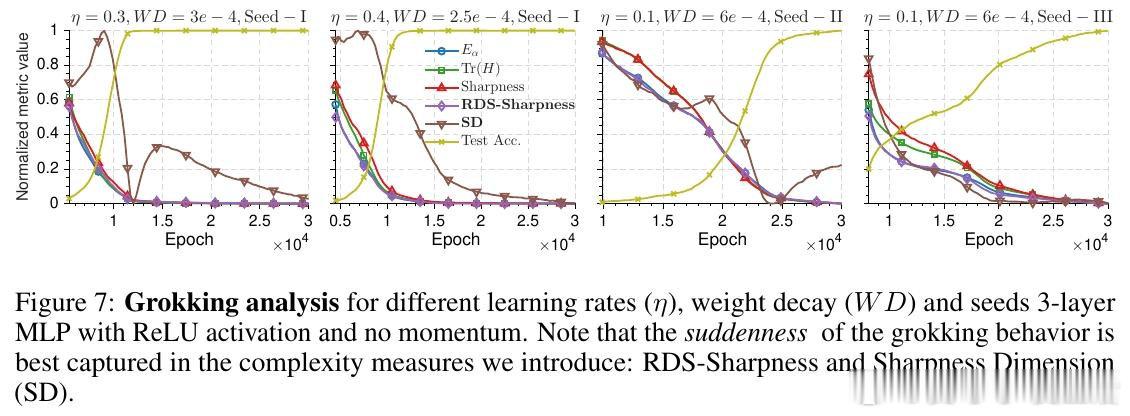

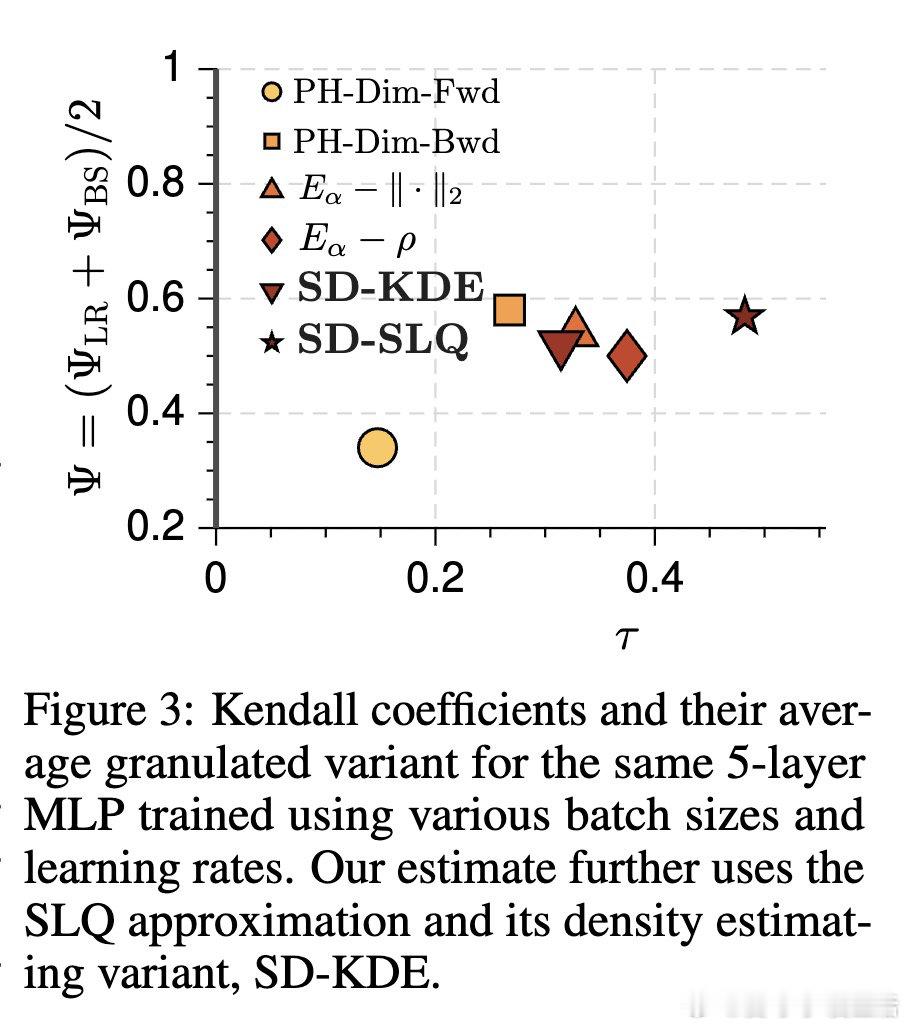

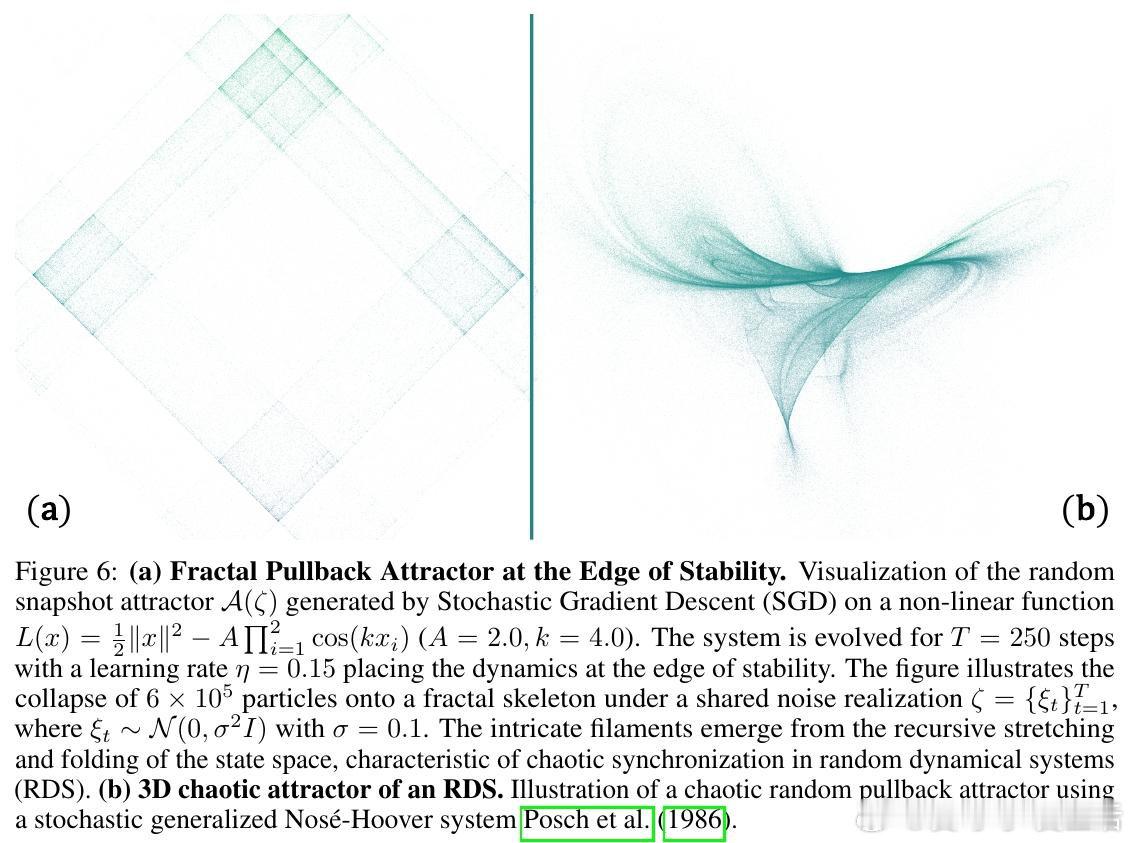

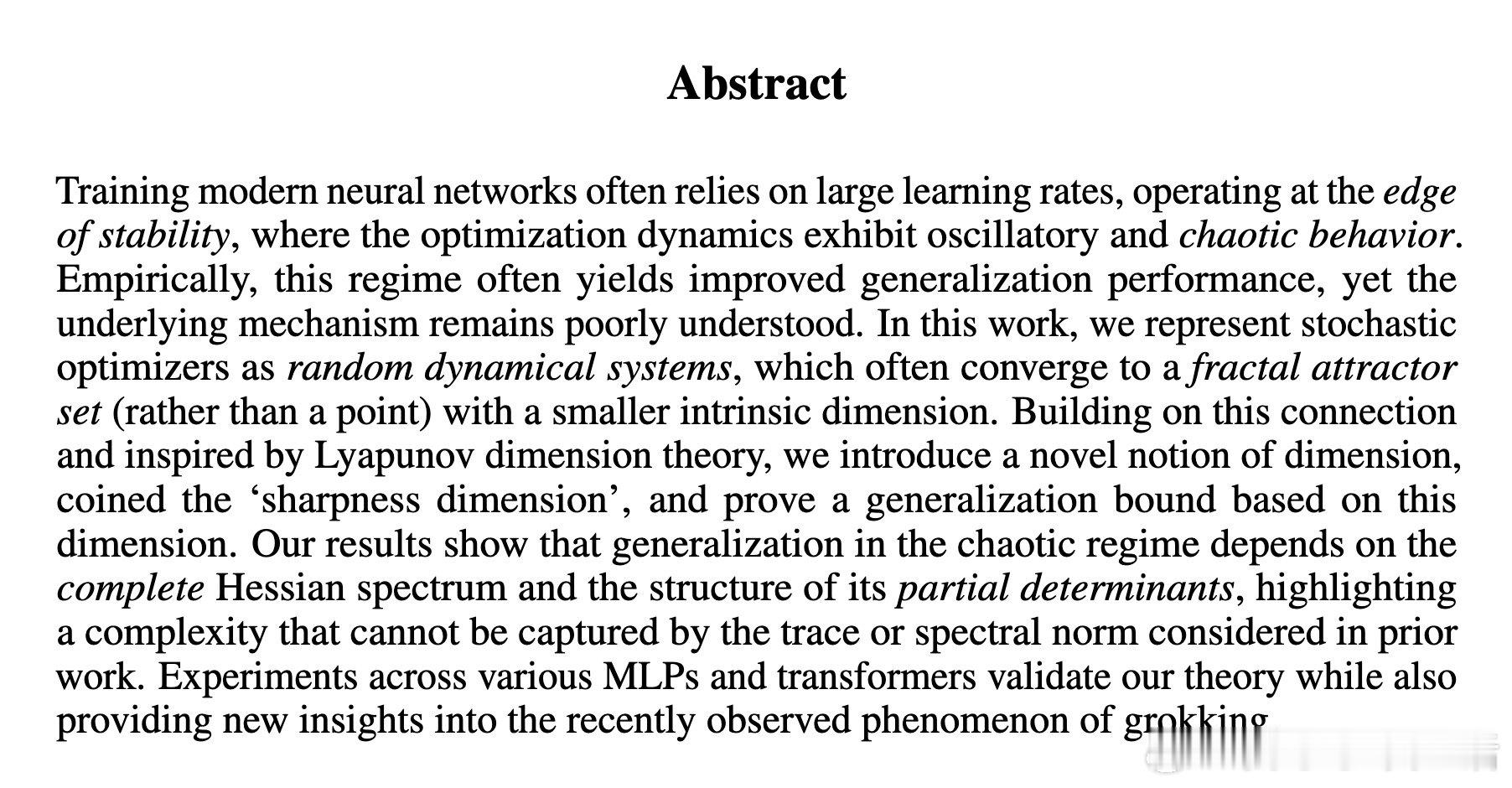

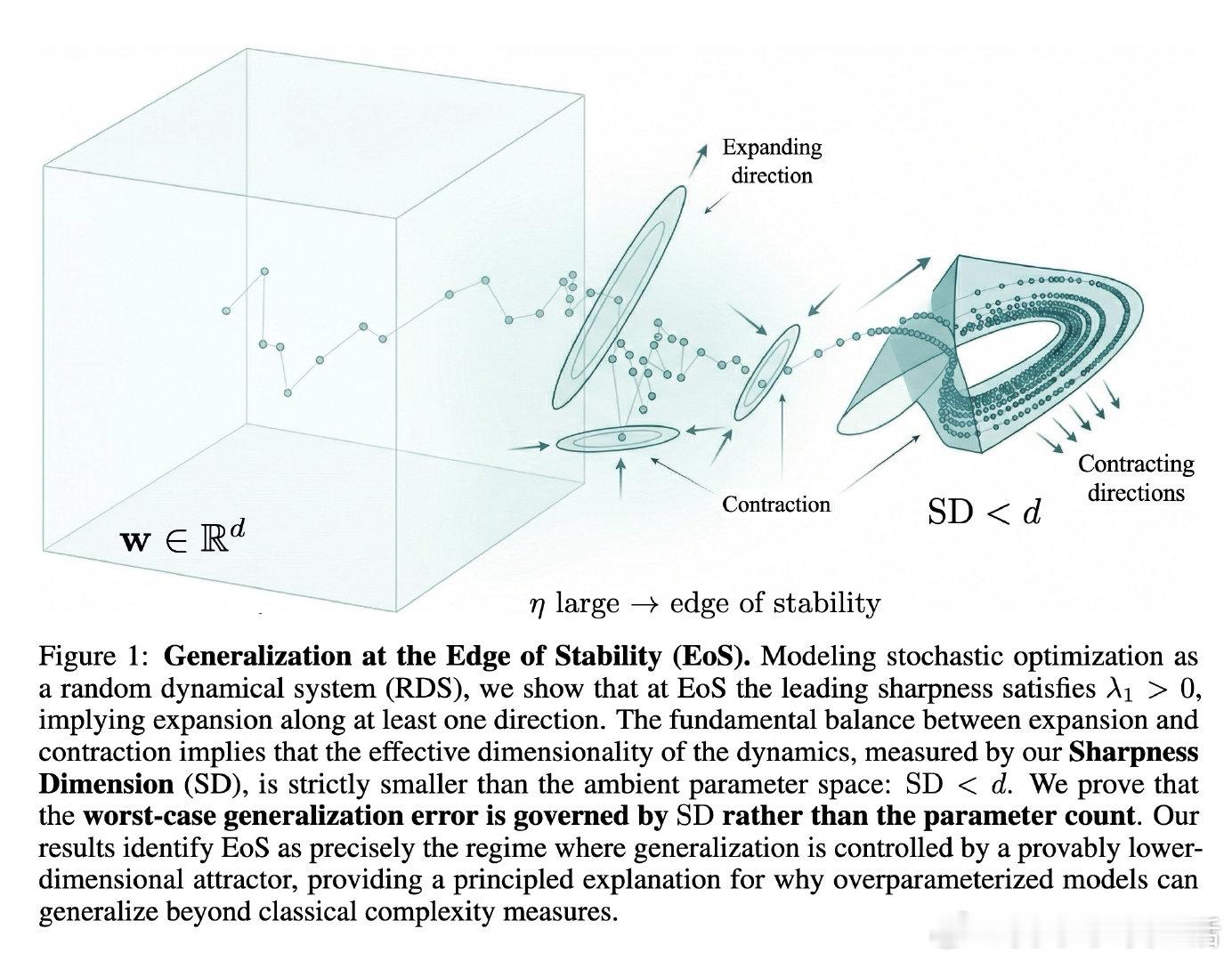

本文将随机优化器建模为随机动力系统(RDS),证明EoS下优化不收敛到单点,而是探索一个分形吸引子集合。核心洞见是:当最大奇异值λ₁>0(即至少一个方向扩张)时,扩张与收缩的平衡使吸引子的有效维度严格小于参数空间维度。由此引入"锐度维度"(SD),它由完整Hessian谱的偏行列式结构决定,而非仅依赖迹或谱范数——SD量化了吸引子在扩张方向上的有效自由度。

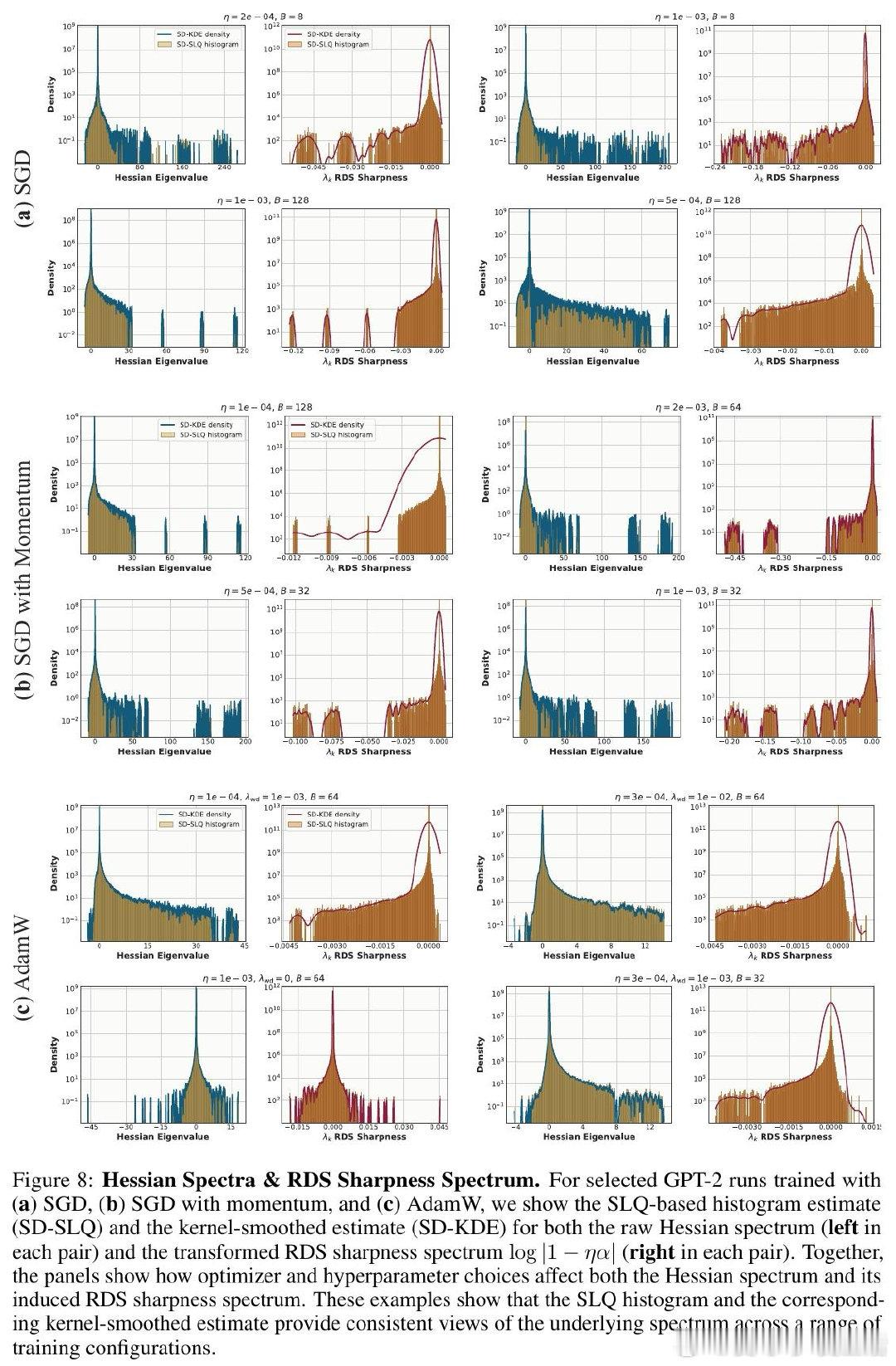

这项工作将EoS、混沌动力学与泛化界统一:证明了最坏情况泛化误差由SD而非参数量控制,解释了过参数化模型为何能超越经典复杂度度量泛化。它为后来者打开的新门是:通过随机Lanczos二次型可扩展计算SD,在MLP、GPT-2及grokking现象中验证了理论。但尚未跨过的门槛是:当前需估计全Hessian谱(尽管有近似),且理论仅覆盖SGD类优化器,对自适应优化器(如AdamW)和超大规模Transformer的扩展仍待完善。

arxiv.org/abs/2604.19740 机器学习 人工智能 论文 AI创造营