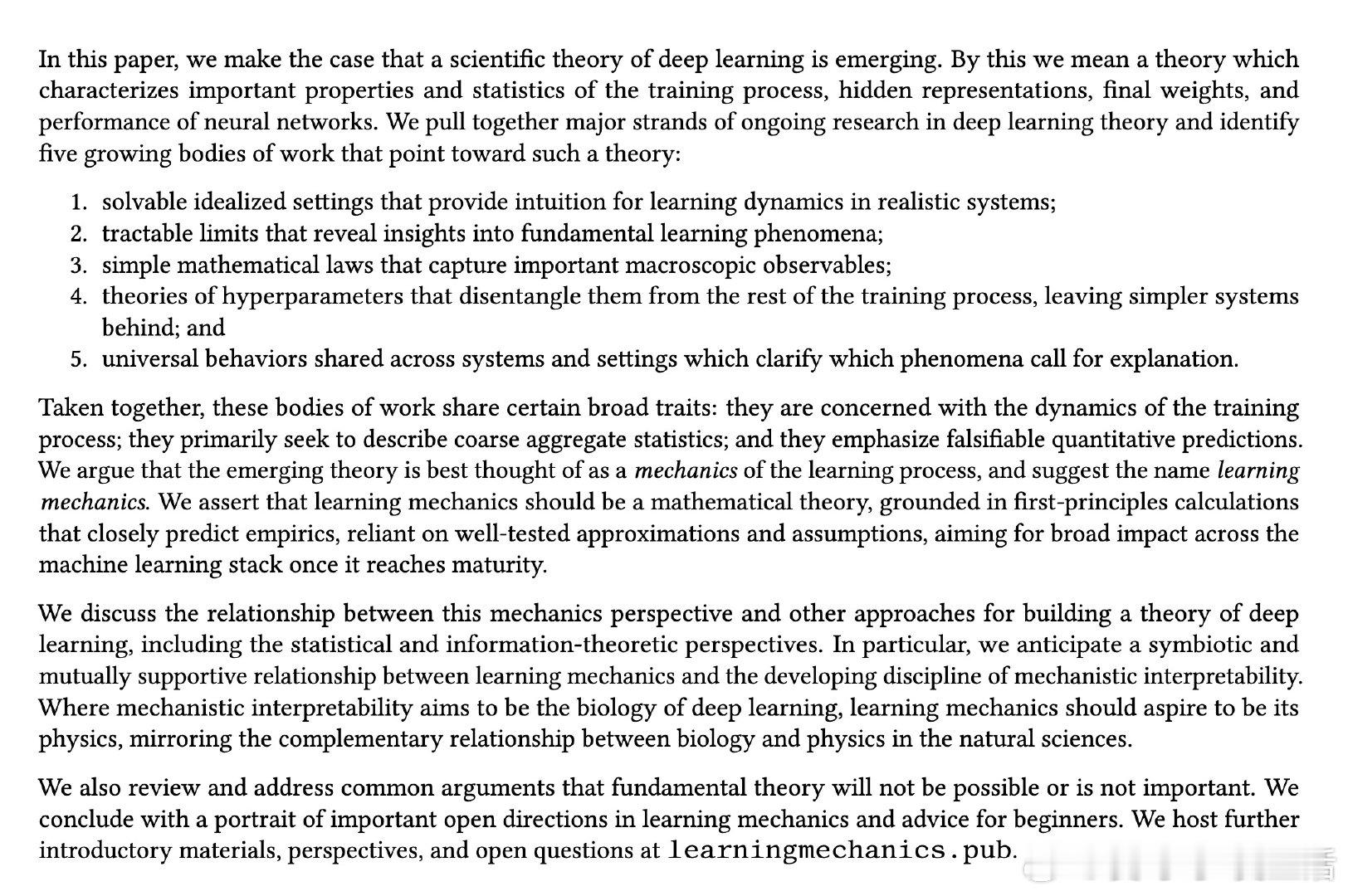

[LG]《There Will Be a Scientific Theory of Deep Learning》J Simon, D Kunin, A Atanasov, E Boix-Adserà… [UC Berkeley & Harvard University] (2026)

深度学习虽然在实践中取得了巨大成功,但我们对其工作原理缺乏统一的科学解释。现有理论要么局限于过度简化的场景,要么只能给出定性描述,无法预测真实神经网络在训练过程中的动态行为、内部表征的演化以及最终性能。这种理论与实践的脱节,使得模型设计仍然依赖试错,而非第一性原理。

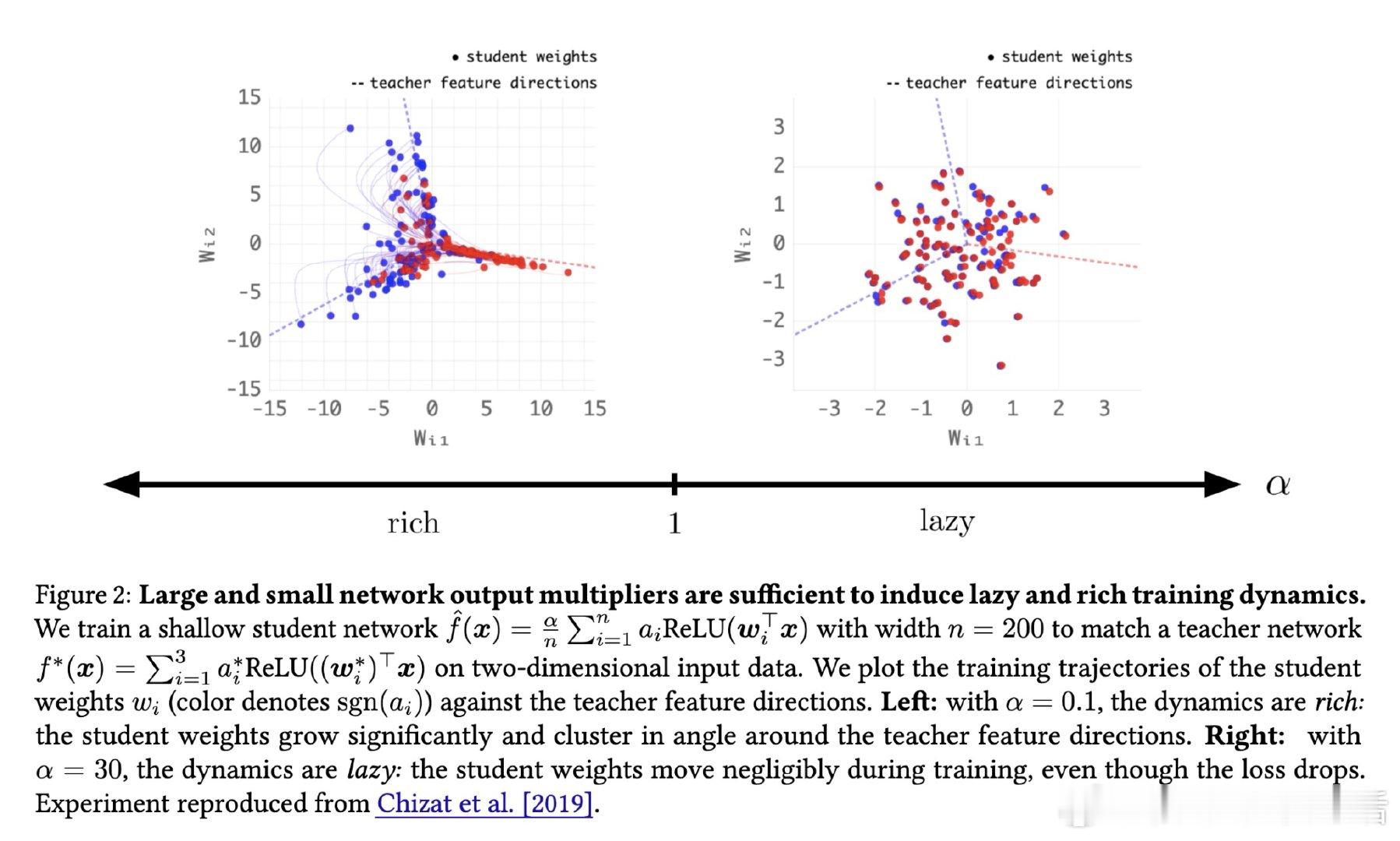

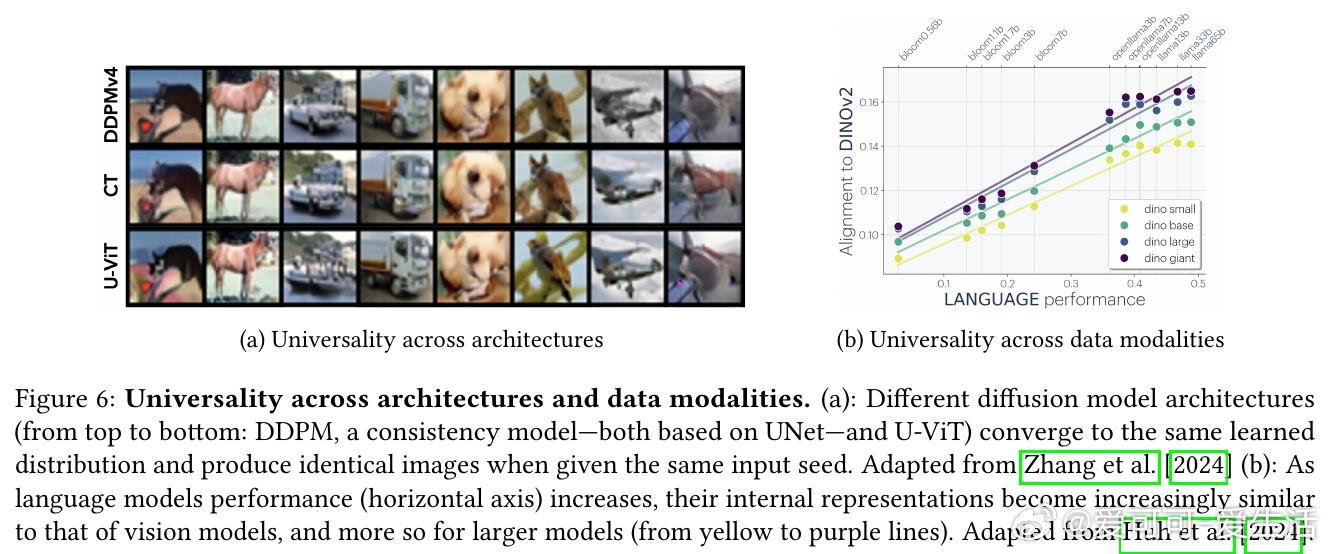

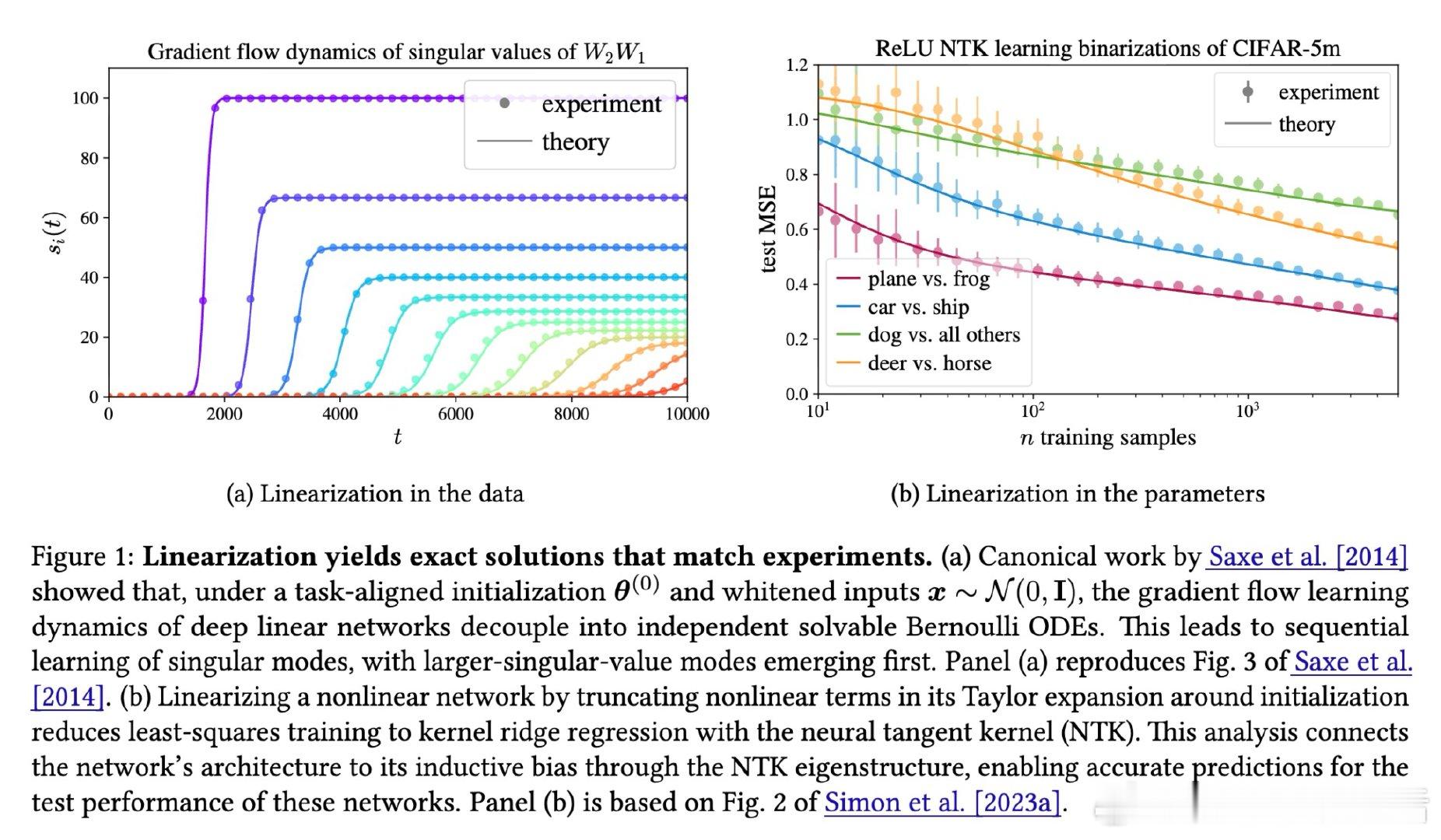

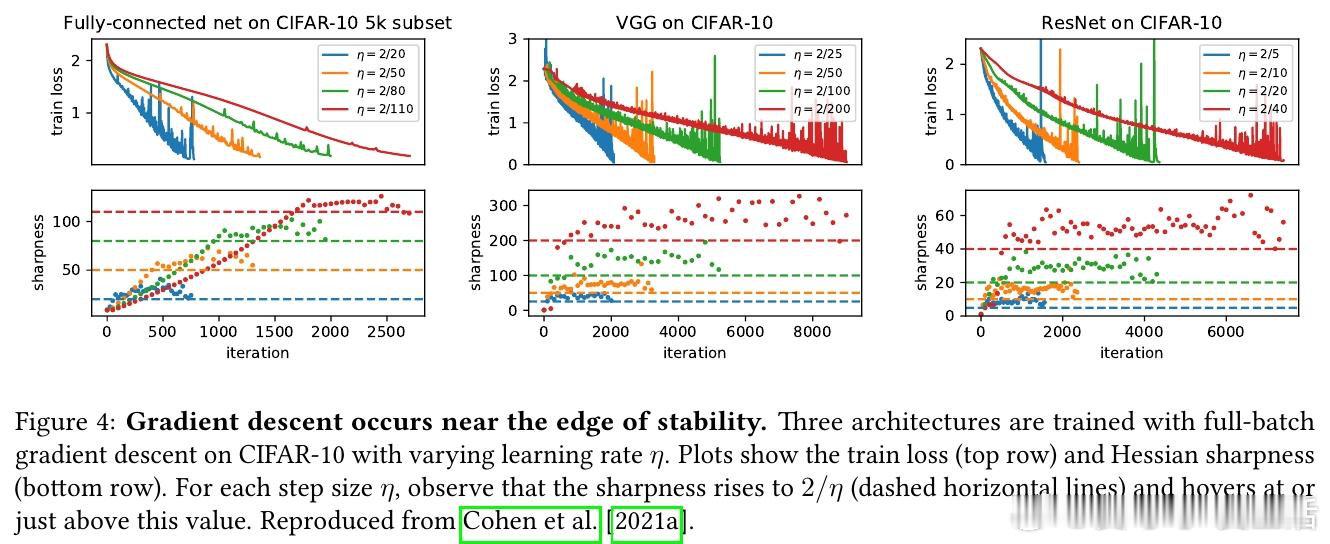

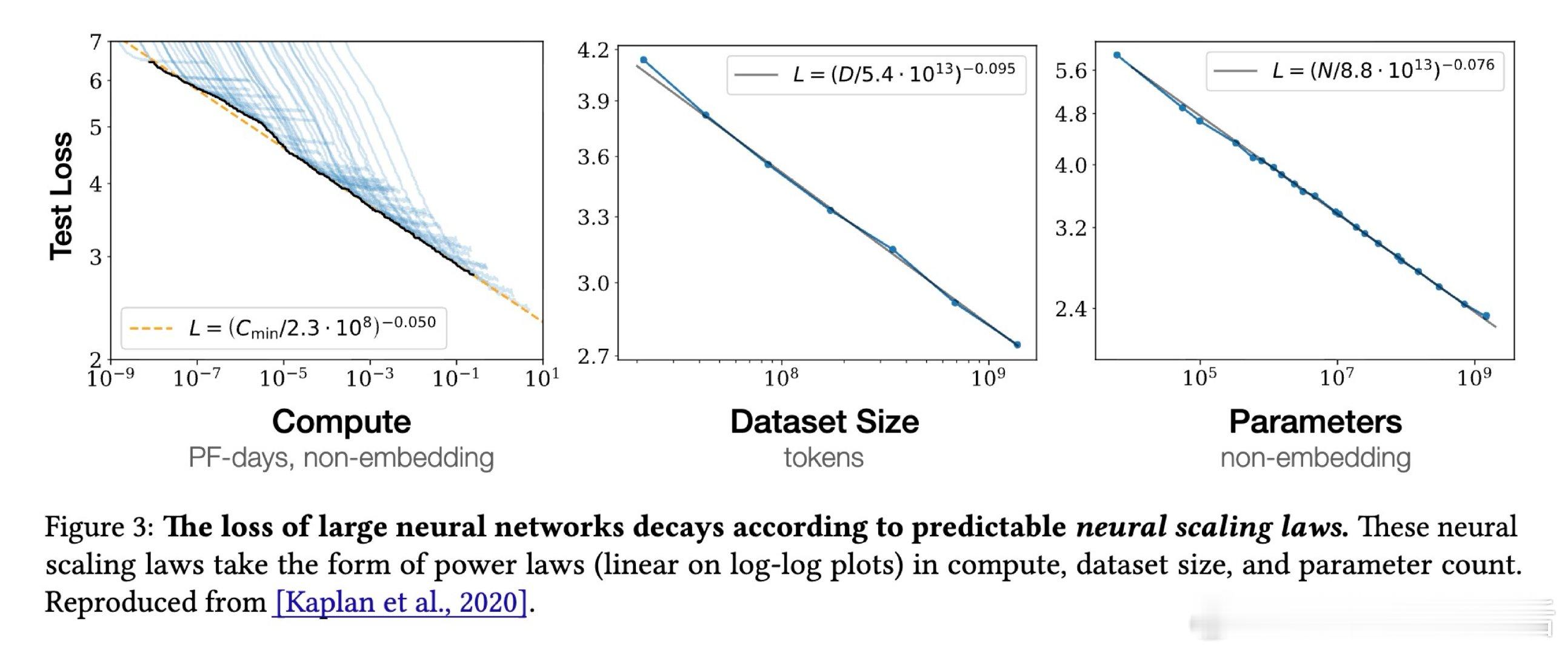

本文的核心洞见是:将深度学习理解为一种"学习力学"——类比物理学中的经典力学、统计力学。通过五条证据线索(可解析的简化模型、揭示本质的极限分析、捕捉宏观统计量的简单经验定律、超参数的解耦理解、跨系统的普遍现象),表明一个关注训练动力学、描述粗粒度统计量、强调可证伪定量预测的科学理论正在浮现。

这项工作真正留下的遗产是为深度学习建立了一个类似物理学的理论框架愿景。它为后来者打开的新门是:将神经网络训练视为可用数学定律描述的动力学过程,从而指导架构设计、优化策略和安全性研究。但尚未跨过的门槛是:如何从第一性原理预测真实大模型(如语言模型)的缩放律指数、如何形式化定义特征学习、以及如何将这套理论扩展到所有实际场景。

arxiv.org/abs/2604.21691

机器学习 人工智能 论文 AI创造营