[LG]《Parcae: Scaling Laws For Stable Looped Language Models》H Prairie, Z Novack, T Berg-Kirkpatrick, D Y. Fu [University of California, San Diego] (2026)

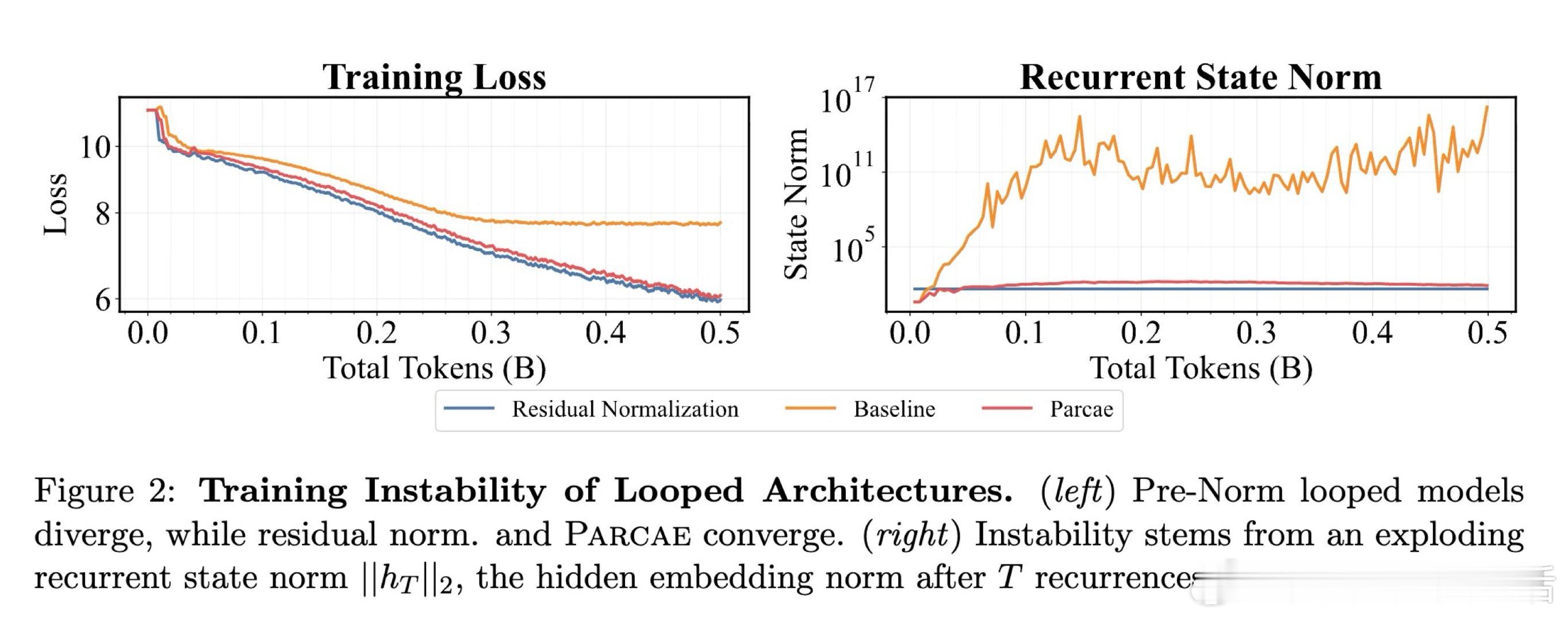

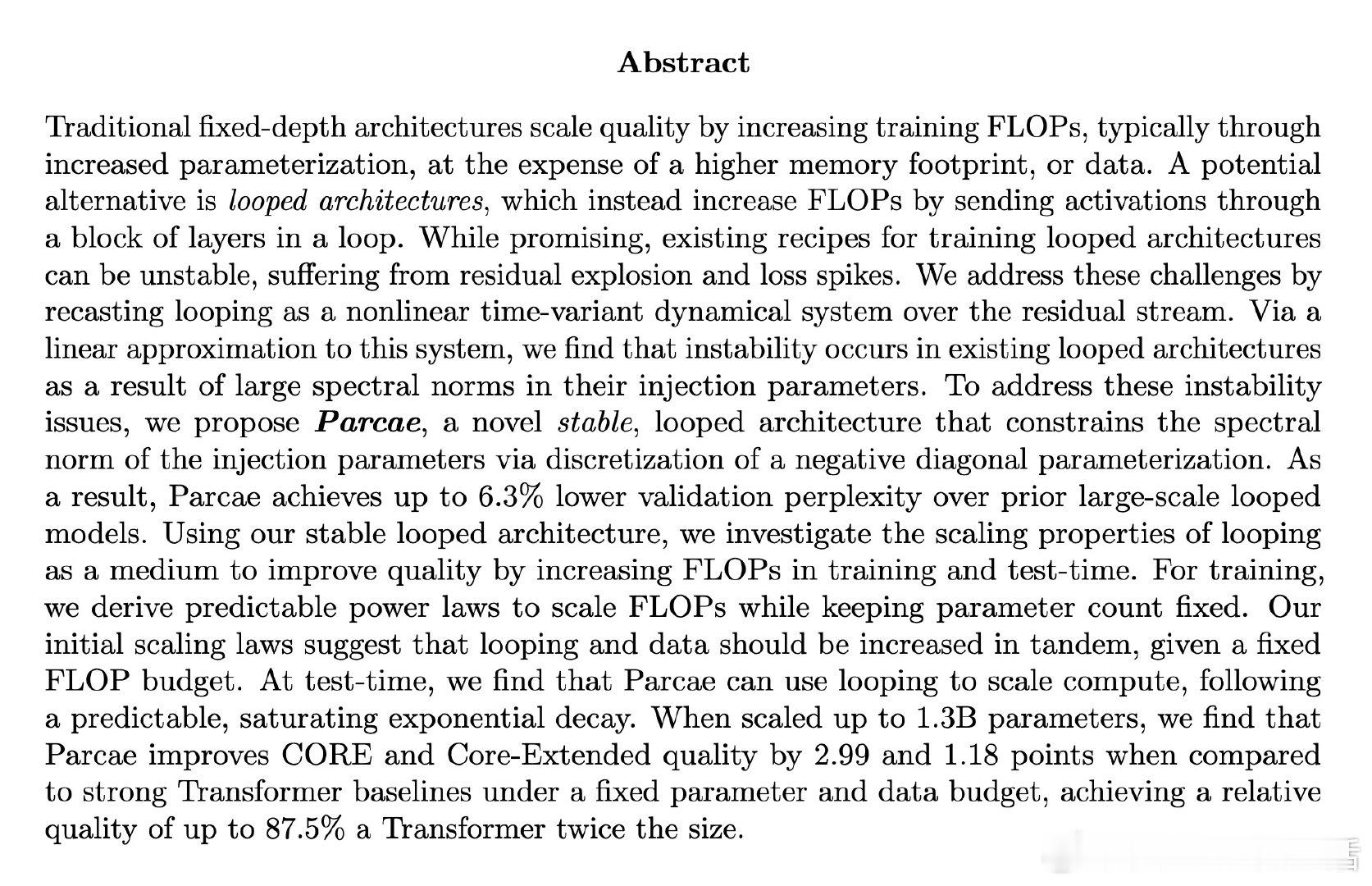

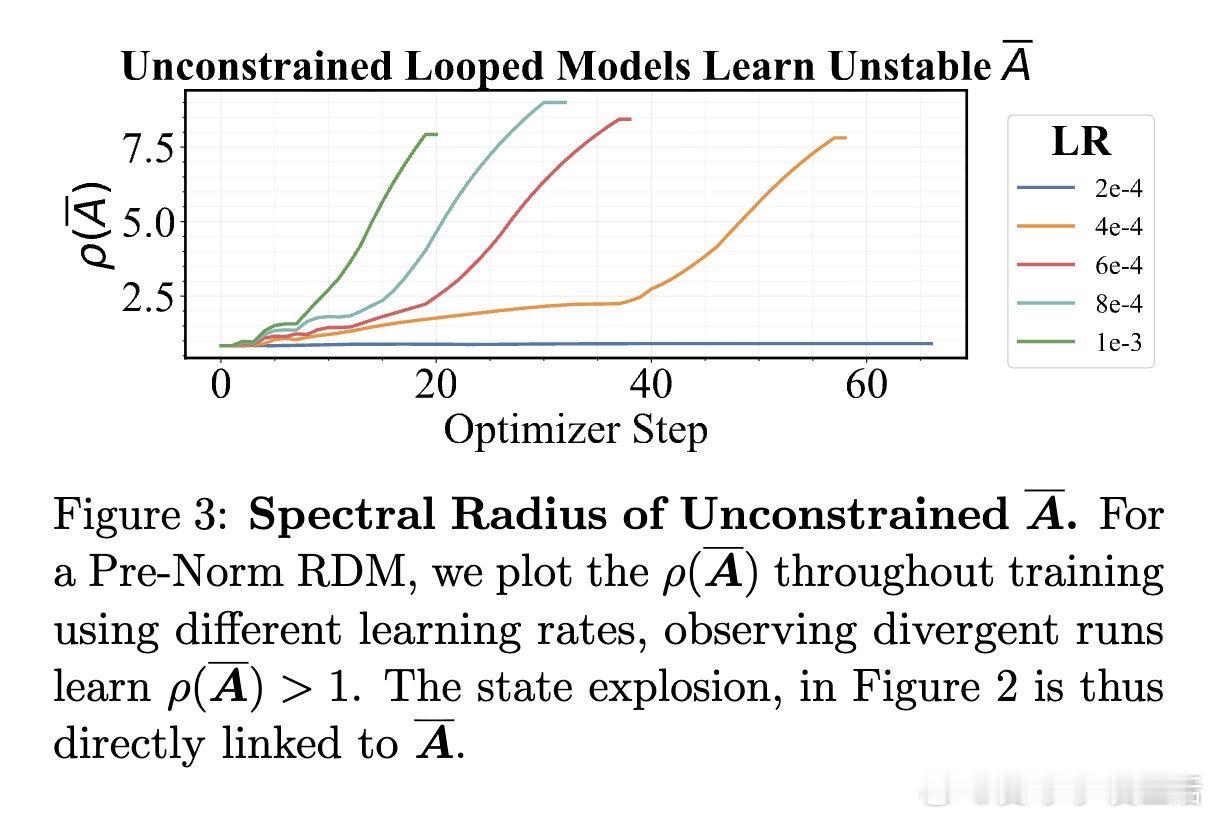

在循环深度语言模型领域,训练稳定性是一个悬而未决的难题。过去的方法受困于残差爆炸与损失尖峰,本质原因是注入参数的谱范数未受约束,导致隐藏状态在循环迭代中无限膨胀。

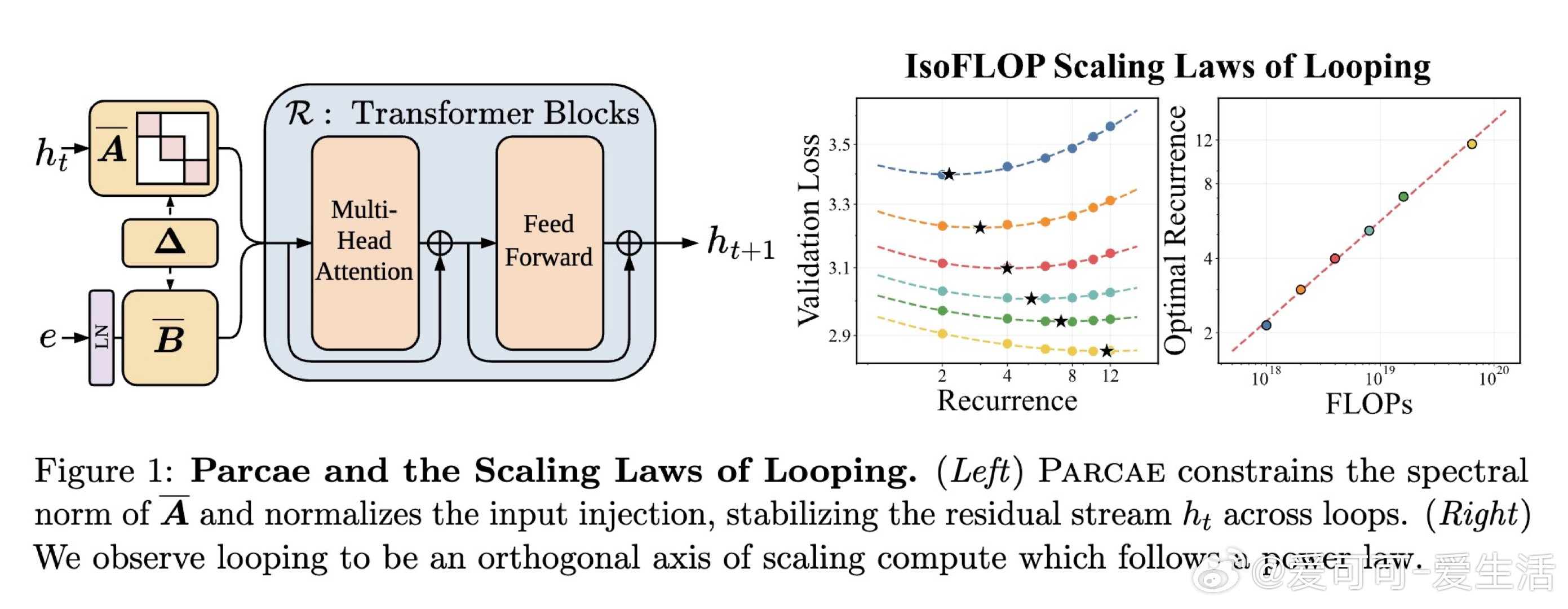

本文的核心洞见是:把循环层的前向传播重新看作一个非线性时变动力系统。由此,将注入矩阵参数化为负对角矩阵并经零阶保持离散化这一关键操作,将谱半径强制约束在1以下,使残差流得以收敛。

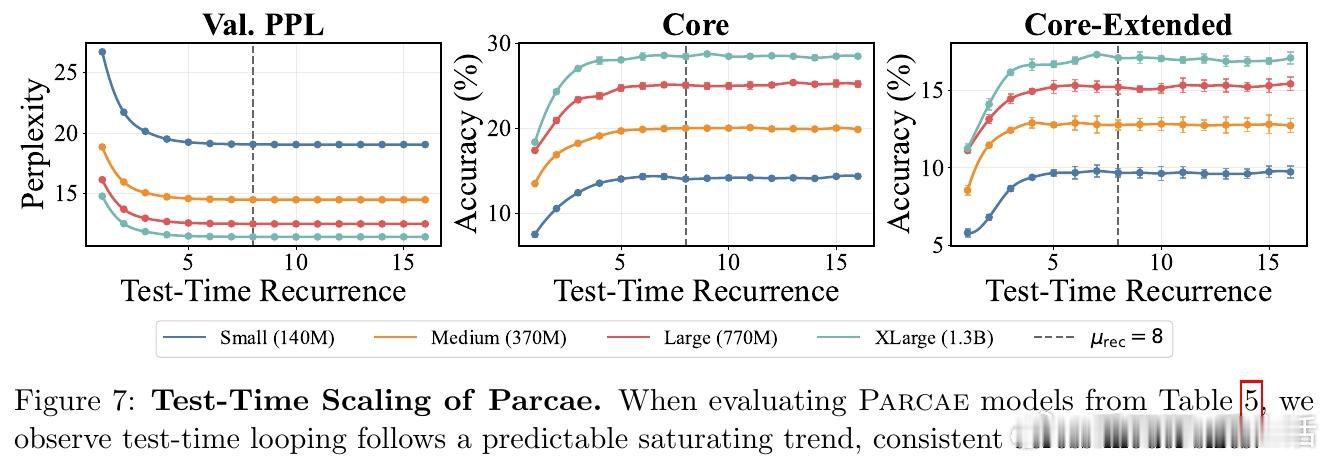

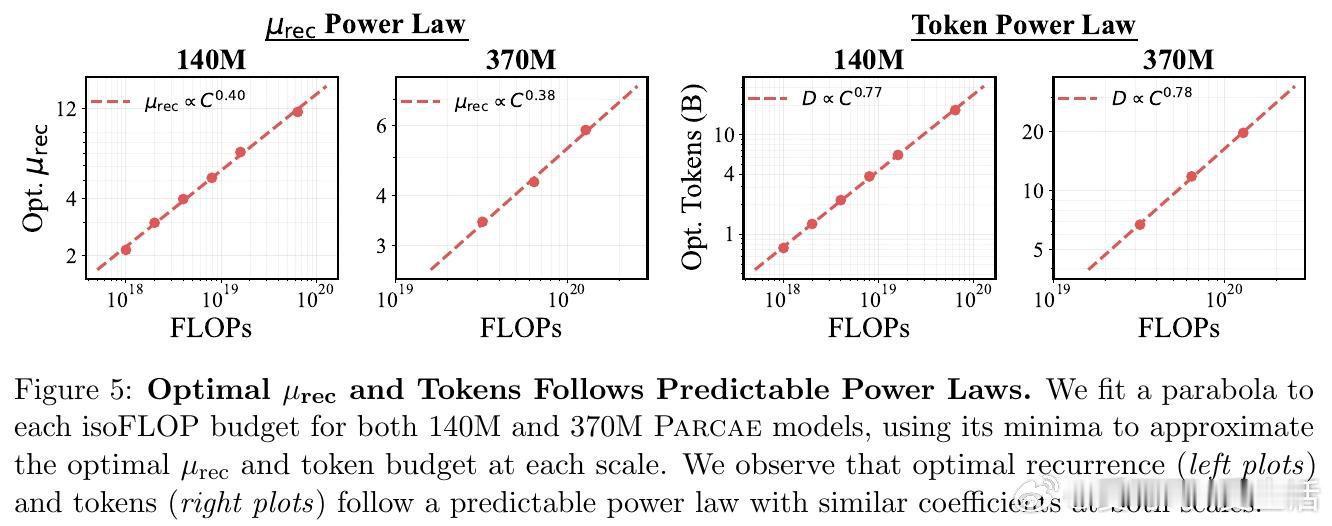

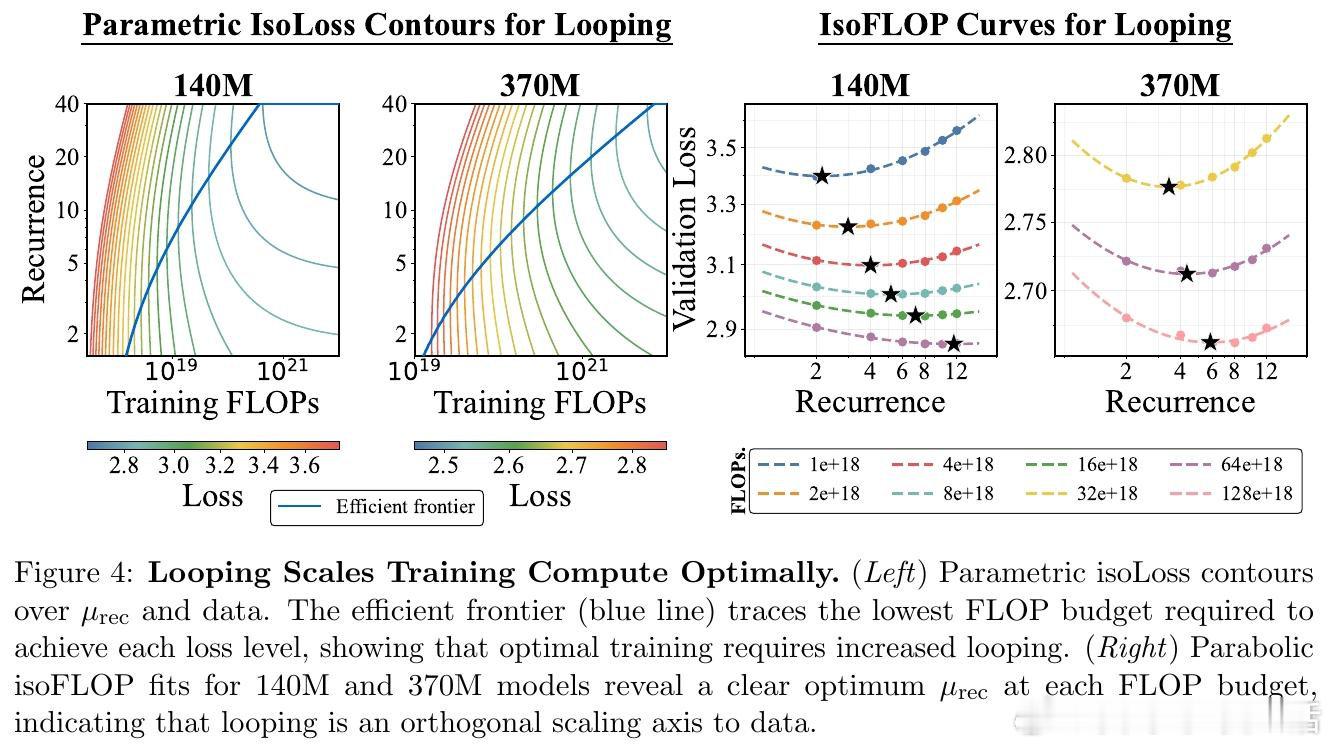

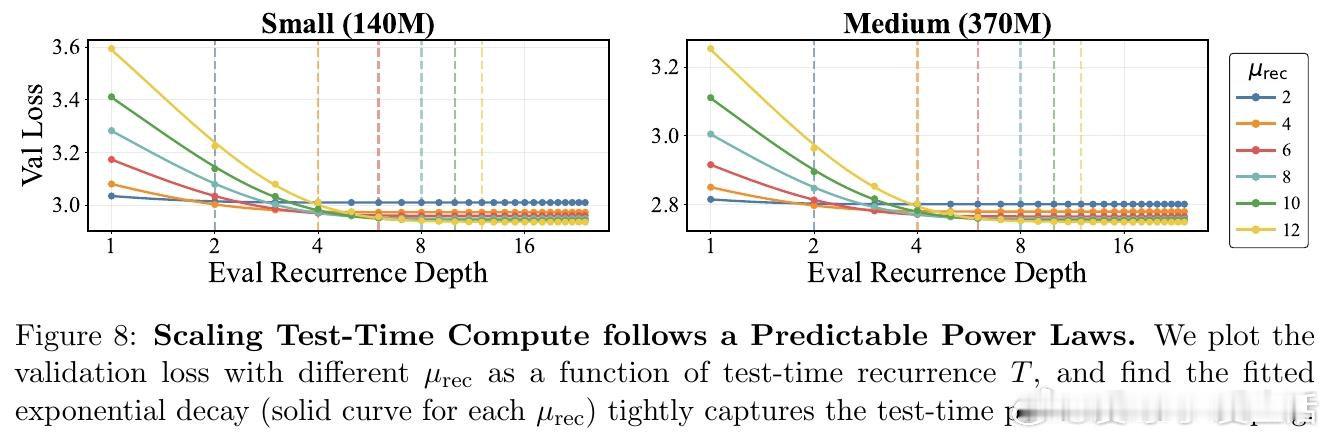

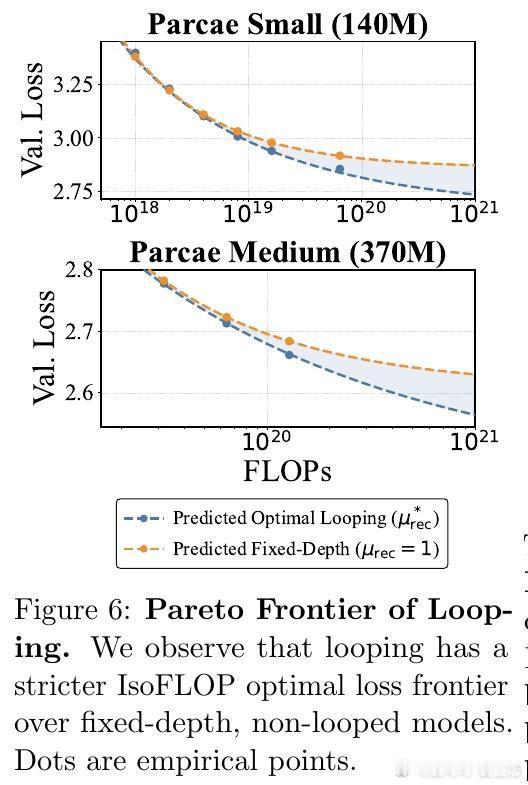

这项工作真正留下的遗产是:证明了循环次数是独立于参数量与数据量之外的第三条算力扩展轴,并为训练期与推理期的循环深度分别建立了可预测的幂律与饱和指数衰减律。它为后来者打开的新门是:在固定参数预算下,通过联合调度循环深度与训练数据实现更高的FLOP效率。但尚未跨过的门槛是:当前规律仅在13亿参数以内验证,循环深度、参数量与数据量三轴协同最优扩展的通用法则仍属未知。

arxiv.org/abs/2604.12946

机器学习 人工智能 论文 AI创造营