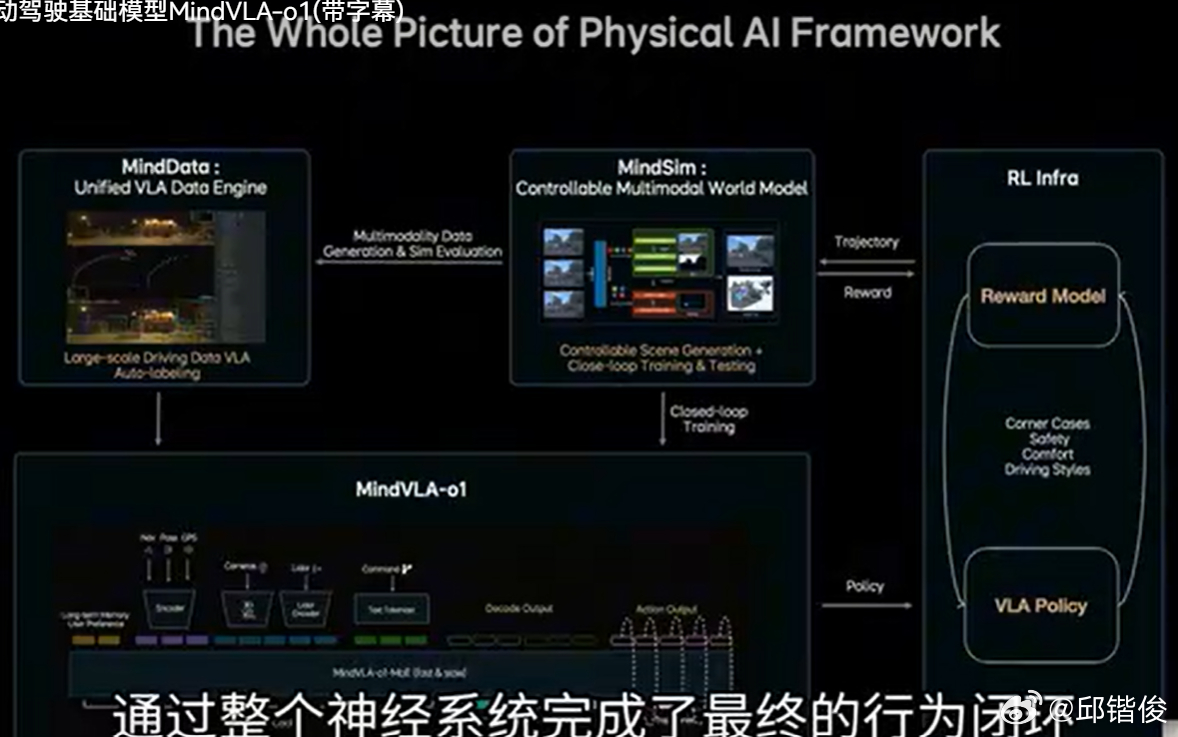

刚刚完整学习了一下理想汽车基座模型负责人詹琨在GTC2026的演讲,理解能力不太好,随便复述几个亮点:1是3D VIT,之前所有的智驾都需要对行车环境进行重建,基本依靠的都是通过2D“翻译”成3D的形式,比如视觉。但理想这次设计了3D视觉的空间编码器,也就是3DVIT encoder,用于对真实世界三维结构进行直接建模。与传统方法不同,它并不是简单的将2D图像和3D信息进行拼接,而是在编码阶段之间构建3D的空间表示。这使得模型能够更加自然的理解真实的物理世界的空间结构。在训练过程中我们同时利用视觉和lidar的数据,这两种模态天然具备空间的对齐关系。雷达提供了准确的三维几何信息,视觉提供了丰富的语义信息。通过自监督训练,模型可以在同一个表示空间中同时学习几何结构和语义信息。理想汽车曾经说,这是全球第一个3D vit.2软硬件的联合设计。詹琨提及,车端算力天然有限,“高精度的模型通常跑不动,能跑动的模型往往精度又不够。”必然要对模型做压缩或者重新架构结构做调整,需要数月时间。理想在架构设计之初,就进行了软硬件协同的设计,这使得模型在车端计算资源下高效运行。同时整个系统采用了统一的MOE架构,天然适合闭环强化学习的训练。“我们提出了一种面向端侧大模型的软硬件协同scaling law方案。在这个框架中,我们不仅建模了模型结果与损失之间的关系,还结合了roof line模型来刻画硬件的计算能力、内存带宽的限制。通过这种方式,我们可以在模型性能与硬件约束之间建立一个统一的分析框架。在实际实验中,我们评估了接近2000种不同的模型架构配置,并在英伟达的orin和store平台上进行了验证。最终我们成功找到了模型精度与推理延迟之间的帕雷托前沿。这条曲线告诉我们在给定的计算预算下,模型的层数隐藏的维度MOE的激活比例,应该如何组合才能达到性能的最优。这里有一个有意思的观察,在端侧计算资源受限的情况下,更宽且更浅的模型结构往往比传统的深层模型更加有效。通过这一套软硬件协同的设计方案,我们将模型探索的架构探索的时间从数月缩短到了几天。这大大提升了端侧VLA的模型设计效率和部署速度。”3最后,可能是最重要的一点。詹琨说,Mind VLA o-1不只是一个单独的模型,也不只是面向自动驾驶的,而是一整套面向物理世界智能的AI框架。“这意味着我们可以使用同一套基础模型、同一套技术范式、同一套数据系统去训练不同形态的物理智能体。所以从某种意义上说,自动驾驶只是物理AI的一个起点。未来类似的基础模型将驱动车辆、机器人、机械臂以及各种物理系统”。