硅基生命的童年:当一辆汽车开始重构“物理常识”

在很长的时间里,人类对自动驾驶的想象,依然被“机械主义”所困扰。

在“机械主义”的世界里,汽车这样的交通工具根据大量的规则和图纸所生产,那么它的行驶也是一定

有规则性的。于是,自动驾驶工程师们试图穷尽物理世界的所有可能性,将它们编写成几十亿行的规则

:

红灯停,绿灯行,绿灯有人先停再行绿灯有人但人走的快蠕行通过绿灯有人但人走的很快然后又回头了还是要停……

一切似乎能看到成功的尽头,但是真实物理世界的复杂和混沌,终究还是彻底击碎了人类工程师们贫瘠

的想象力,当穿着停止符号的人横穿马路,当侧翻的异形货车拦在路当中,当一切未经过人类想象的画

面出现在自动驾驶汽车面前,系统瞬间陷入致命的瘫痪。终于,有工程师喊到:“尽管我们爬的越来越

快了,但问题是,我们并不知道山到底有多高”?

一、找不到终点,又回到原点。

发展心理学家皮亚杰曾提出过“客体永久性”的概念。一个半岁前的婴儿,如果看着母亲用一块布将玩

具盖住,他会认为玩具“消失”了;但在几个月后,他会主动伸手去掀开那块布。在这个过程中,没有

人向他灌输过物理定律,他是通过日复一日的观察,依靠本能建立起了对物理空间最基础的常识——他

开始懂得,被遮挡的物体并未湮灭,懂得掉落的苹果受制于重力,懂得远处驶来的汽车因为距离的拉近

而在视网膜上不断变大。

而在很长一段时间里,早期规则驱动的自动驾驶系统,恰恰困在了 “客体永久性” 的门槛前 —— 它能识别视野里的自行车,可一旦目标被旁边的公交车短暂遮挡,系统就会丢失对它的持续追踪,甚至将其从感知列表中抹除。当自行车再次从遮挡中出现时,系统便会陷入突发的认知冲击,带来极高的行车风险。

后来行业普及的 BEV+Transformer 架构,虽然初步解决了遮挡目标的时序追踪问题,但本质上依然是对视觉特征的识别与拟合,并未建立起对三维物理世界的底层通用认知。我们终于明白,此前我们教了机器太多 “遇到什么情况该怎么做” 的规则,却从未让它真正读懂规则背后,那个真实、混沌、充满不确定性的三维世界。

理想汽车的工程师们开始思考,如何让机器真正掌握世界运行的本质规律。他们跳出了 “教 AI 每一步该怎么操作” 的固有思路,转而将几千万小时、以自监督学习为主的真实人类驾驶视频喂给模型 —— 无需人工逐帧标注哪里是车、哪里是人、哪里是树,仅靠基础的车辆标定与时序同步信息,就能让模型在海量数据中自主学习。

这就像回到孩子很小的时候,让他不停的接触,而且是在真实的3D世界里接触,让孩子脑海里建立了一个动态的3D模型,即使自行车被卡车挡住了,脑子里依然能在高维空间里推演出:“这辆自行车还在,并且以 15km/h 的速度在移动,1 秒后它会从卡车车头穿出来”。

二、项庄舞剑,意在沛公?

回到我们原来的话题,理想为什么要这么做呢?在回答这个问题之前,我们可能要讨论下:“到底该怎

么教一个人开车”?

理想现在给出的答案是:“要先理解这个世界”。

如果你教一个没有物理常识的成年人(对应以前没有经过大规模 3D 预训练的模型),你得告诉他:“

前面有个白色的长方形(卡车),不要撞上去;那是个水坑,抓地力会变小……”他死记硬背,遇到一

个没见过的“异形障碍物”就直接撞上去了。

在理想的 3D ViT 架构中,感知主要靠视觉(摄像头),但它并没有扔掉激光雷达,而是把激光雷达扫

出来的点云数据,当作三维几何的真值补充去喂给 3D ViT。这相当于在 AI 看画面的同时,旁边有个激光雷达在低声告诉它:“前面那个东西不仅是红色的,而且它是凸出来的,离你5米。”

通过这样的预训练,我们得到不是一个没有任何物理基础的孩子,而是一个 18 岁、已经在这个物理世

界生活了十几年的人,你教他开车只需要去驾校学 30 个小时。因为他已经完全理解了空间、距离、速

度和物理碰撞的后果,你只需要教他“怎么操作方向盘和油门”。

这种让 AI 先建立三维物理世界底层认知的逻辑,真正打破了此前自动驾驶的范式瓶颈。过往很多自动驾驶方案,是在二维图像语义识别的基础上做规则化的路径规划,对三维世界的理解是碎片化、后置的、依赖人工定义的;而 3D ViT 架构,是让 AI 真正 “睁开眼睛” 读懂三维空间,像人类幼崽一样,用成千上万个小时的真实世界观察,在数字空间里拟合出一整个符合物理运动规律的三维宇宙。

从这个视角来看,理想这么做的最大因素就在于要从源头开始补齐“三维世界观”,这个三维世界观并

没有教会驾驶员怎么开车,但是却教会了如何理解空间、距离、速度和物理碰撞的后果。

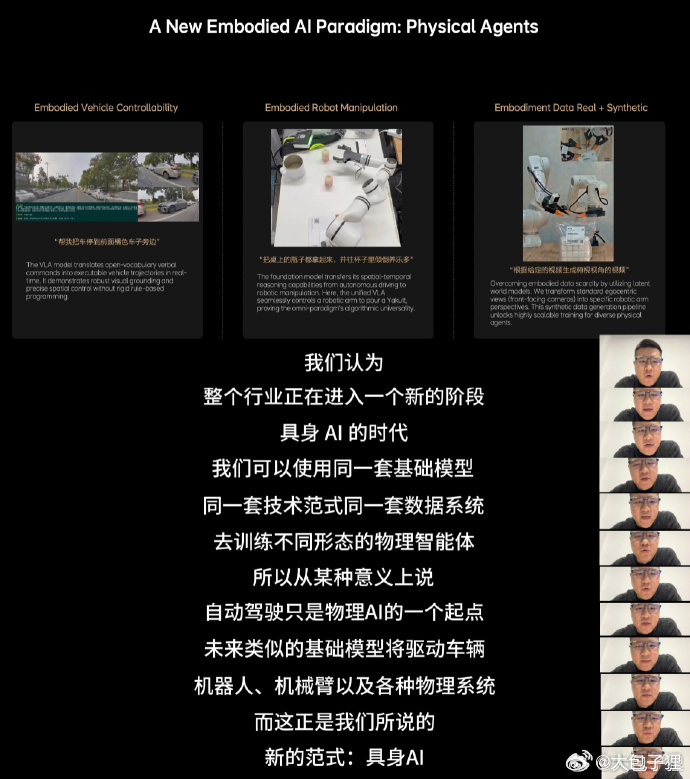

有了这个扎实的“三维世界观”打底,AI 后面去学开车、甚至去学开飞机、控制人形机器人,那都只是

“微调”的皮毛功夫了,毕竟他们已经掌握了“物理规律”这样的通识,而后面都是从通识中衍生出来

的技能。

三、“隐式世界”的不同范式

和理想不同,特斯拉的“隐式世界模型”并不容易解释,它更倾向于“让模型自己在海量视频的灌输下去涌现直觉的能力。

就好像你骑自行车的时候,你不会计算角度,不会计算重心,但当自行车向左倾斜的时候,你会直觉的

向右移动身体去试图平衡,这就是直觉的能力。

特斯拉认为,人工定义的世界并不完美,你建模的世界,是“你理解的世界”,不是“真实世界”。所

以,只要给我足够多的数据和足够大的模型,车辆一定会在过程中“行动逼近理解”。

然而在“行动逼近理解”的过程中,理想增加了一步“理解当下的行动”,用VLA架构去引入语言和显式

推理,让激光雷达去提供几何先验信息,通过快慢双系统提供可解释性,让3D Vit、世界模型、思维链

成为“易于理解的显式模型”。如果说,特斯拉追求“像人一样的直觉驾驶”,那么理想在这个层面上

加上了“像人一样理解和解释驾驶”,并通过这一解释向更多的AI领域进行扩张。

时代的潮水正在悄然改变流向。当我们在讨论 3D ViT 或者端到端大模型时,我们讨论的其实早已不是

一项让汽车平稳变道的辅助驾驶技术,而是整个进入AI时代的通行证。

如果今天我们要为这场路线之争寻找一个裁判,也许可以将此视为一个判断未来的隐秘信号:如果在未

来的某一天,我们发现 AI 展现出了极其恐怖的单一任务统治力(比如在任何极端路况下都能把车开得

滴水不漏),那么特斯拉应该居功至伟;而如果那个时代的 AI,不仅能开车,还能自然地走下车,走进

你的厨房,拿起抹布熟练地擦拭一张三维的餐桌,那么理想今天对于“理解世界”的执拗,便得到了最

伟大的正名。

但无论如何,我们或许应该意识到,自己正身处于一场伟大进化的前夜。而那个陪伴我们穿行于都市夜

色的,不再是一段冰冷的程序,而是一个正在逐渐读懂这个世界的、成长的灵魂。

此刻,也许正是硅基文明的童年。李想称机器人也用VLA理想发布下一代自动驾驶基础模型李想回应ai时代的焦虑