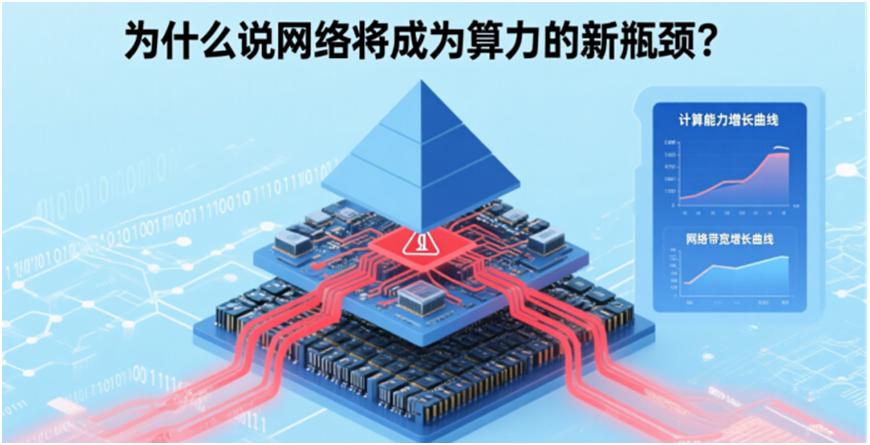

十万卡时代来临!为什么说网络将成为算力的新瓶颈?

大模型参数每年增长10倍:GPT-3(1750亿,2020年)→ 万亿参数(2024年)→ 十万亿(即将到来)。

这意味着什么?算力需求不是线性增长,是指数爆炸。千卡不够用,万卡成标配,十万卡已经在路上。

但有一个残酷的现实:很多人以为堆GPU就行,真正做过大规模训练的工程师会告诉你——决定系统上限的,不是算力芯片,而是网络。

来看一组数据:在一些超大规模训练任务中,网络通信时间占到总训练时间的30%-50%。什么意思?你花10个亿买的GPU,有3-5个亿的时间在“等消息”,算力利用率被网络拖垮。

这就是所谓的木桶效应——最短那块板,决定整个集群的效率。到了十万卡规模,GPU越来越强,网络就成了最短那块板。

为什么网络会成为瓶颈?

通信量爆炸:万卡级集群,每轮训练AllReduce通信量随卡数平方增长,单轮数据量可达TB级。

并行策略苛刻:数据并行、张量并行、流水线并行同时工作,要求网络同时扛住高频低延迟和大带宽稳定传输。

丢包零容忍:RDMA最怕丢包,0.01%丢包率就能让训练吞吐崩溃。

传统InfiniBand单子网规模上限约5万卡,这成了十万卡集群的天花板。而国产IB方案把天花板顶到了11万卡——通过对地址空间和协议结构的重新设计,为十万亿参数模型铺平了道路。

一位架构师说得好:我们现在做的事,不是简单的复制,而是用我们自己的方式,去翻越那座名为算力巅峰的高山。

当网络不再是瓶颈,AI的想象力才能跑得更远。

十万卡时代 中科曙光