最近,英伟达GTC大会的热度像潮水一样涌来,圣何塞的舞台上,老黄的新芯片、AI工厂的宏大叙事必然是最亮的焦点。 但在芯片之外,国产算力领域的几条新赛道正悄悄跑出加速度——中科曙光的Scale Fabric高速网络、scaleX640超节点,还有上海模合的Shanghai Cube高密度算力系统,这些全自主方案正在AI算力的牌桌上,摆出更完整的国产拼图。 中科曙光的名字总和“超算”绑在一起。早年间服务气象局、中科院的科学家时,他们就领教过最狠的算力考验:分子动力学的小包冲击能把网络打“吐”,气象模拟的全球通信吞吐能压垮集群。

十几年磨下来,曙光攒下了全链路自研的技术底子。这次发布的Scale Fabric高速网络,把这些底子变成了真金白银的产品——400G速率、0.9微秒时延、260纳秒交换转发,交换机端口密度比英伟达NDR高1/4,网卡最大QP数翻一倍,单子网能撑11.4万卡集群。 郑州的万卡集群已经稳定跑了10个月,不是拿芯片拼的组装货,是从112G Sardis IP到交换芯片、网卡、驱动全自己做的硬家伙。 比高速网络更炸的,是曙光的scaleX640超节点。全球首个单机柜640卡的设计,用“一拖二”高密架构把计算、存储、网络拧成一个整体,双节点就能组成1280卡的计算单元,液冷散热系统能扛住1.72MW的热量。 相比传统架构,MOE大模型训练效率提了30-40%,单机柜算力密度是业界其他超节点的20倍,PUE低到1.04。更关键的是“开放”——能适配多品牌AI加速卡,兼容400+主流大模型,不用再绑死在专有系统里。 这种开放不是口号,是曙光“芯-端-云-算”全产业链布局撑起来的,从芯片到服务器,从存储到云平台,每一环都能协同优化。

上海的Shanghai Cube则像国产版的英伟达SuperPod。128卡液冷高密度部署,用沐曦C550 GPU做定制OAM模组,搭云合智网的国产交换机,道客云的操作系统,立讯精密做量产,甚至连液冷、存储、retimer都是国产的。 首套样机已经进了复旦大学张江校区,能跑DeepSeek 671B满血版大模型,单位体积算力和SuperPod差不多。 和传统算力一体机“攒零件”不一样,Shanghai Cube从底层就开始协同——产业链伙伴不是供应商,是联合开发者,从架构设计到优化调优都绑在一起,解决了兼容性的老大难问题。 未来还要加光互连、高速网卡,越迭代越像“算力界的苹果”,把全栈国产做成了优势。

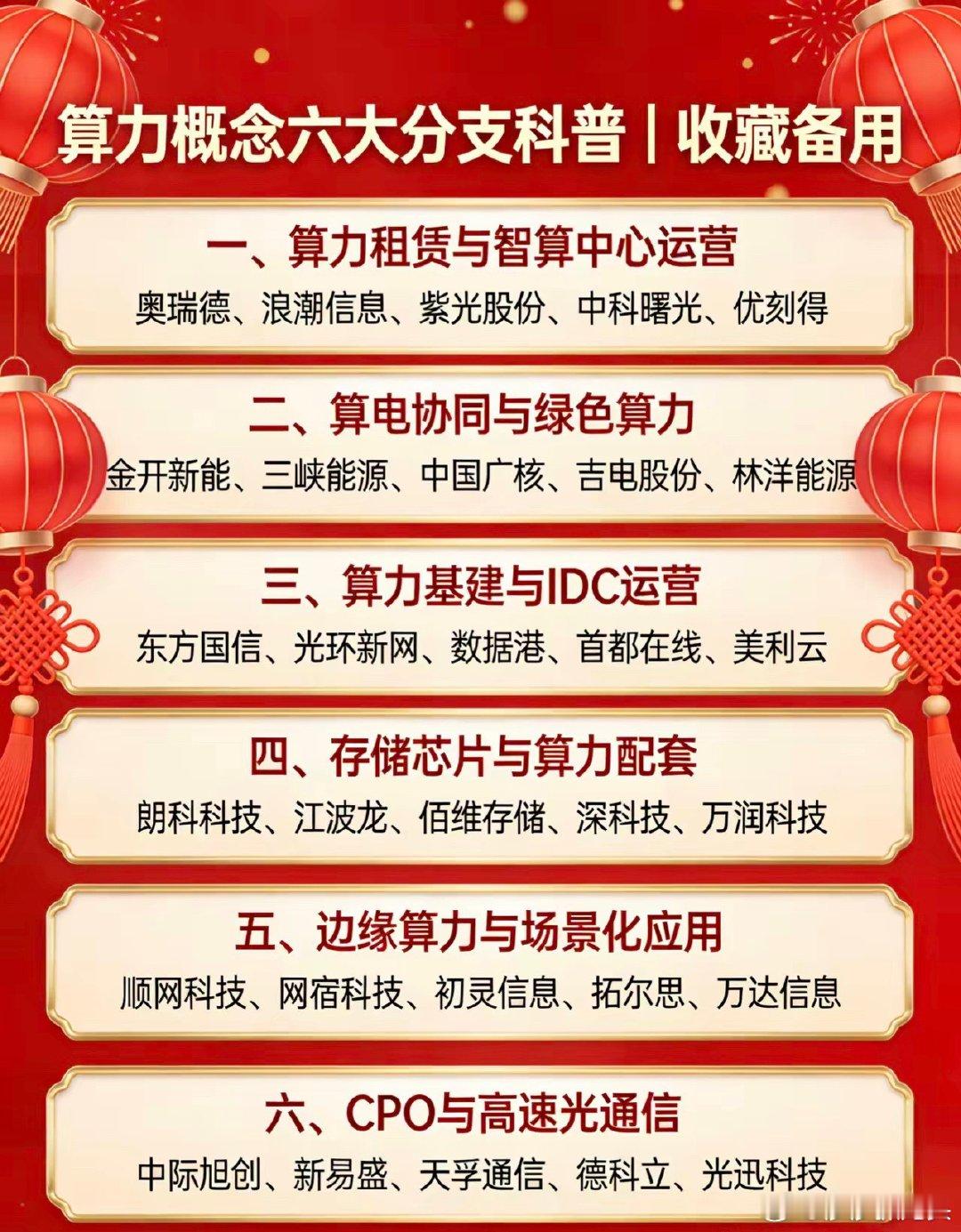

这些方案能跑起来,光互联技术是藏在背后的“神经”。AI算力集群的通信瓶颈越来越明显,传统电互联早不够用了,光模块、光芯片成了必须跨过去的坎。 中际旭创的800G/1.6T光模块已经批量交付,天孚通信的CPO器件切入了英伟达供应链,源杰科技的800G EML芯片在做客户验证,这些企业的技术正变成Scale Fabric的“血管”、Shanghai Cube未来的“光链路”。 英伟达GTC和OFC同期开,光互联必然是焦点,而国产企业早就在这条赛道上跑了很久。

当老黄在GTC讲百万卡集群的宏大叙事时,国产算力已经拿出了能落地的答案——不是跟着走,是用自己的路径,把超算的经验、产业链的协同、开放的架构揉在一起,磨出能和国际巨头对标的方案。 这些方案不是PPT,是郑州稳定运行的万卡集群,是复旦大学里跑大模型的样机,是能适配多品牌的开放架构。AI算力的竞赛里,芯片是发动机,可支撑发动机的网络、机柜、光互联,才是能跑远的底气。国产自主的拼图,正在一块一块拼完整。